JavaScript representa uno de los mayores desafíos para e-commerce y creadores de contenido que buscan visibilidad orgánica sostenida. En esta guía revisaremos los problemas clásicos de javascript seo y sus soluciones prácticas: desde contenido invisible durante el rastreo hasta errores técnicos que frenan el renderizado dinámico. Aprenderás cómo los motores de búsqueda interpretan tu página html, qué herramientas utilizar para la inspección y cómo resolver obstáculos sin complicaciones innecesarias.

Por qué Google no ve el contenido de tu JavaScript

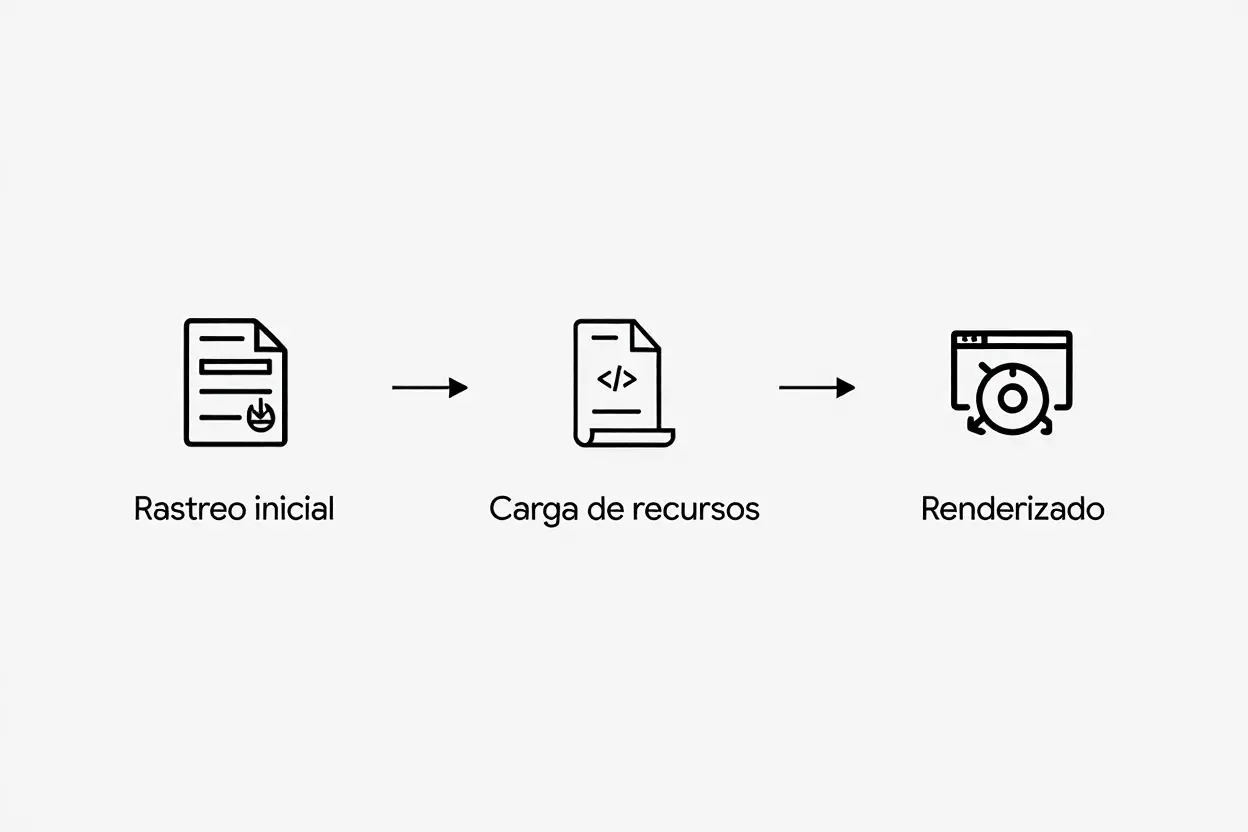

Google procesa cada documento en tres etapas bien definidas: descarga del html inicial, obtención de recursos generados por JavaScript y renderizado dentro de Chromium. Cuando todo el contenido depende completamente de scripts, estas fases se prolongan y tu información puede permanecer invisible para los buscadores durante semanas.

Cómo funciona el renderizado javascript en Google

El renderizado javascript nunca es inmediato: primero googlebot solicita la página html base, luego descarga archivos.js y, finalmente, interpreta todo en Chromium. Si la cadena de peticiones Ajax supera cinco segundos, Google cancela la tarea y deja contenido dinámico sin indexar, generando serios problemas de javascript para SEO.

- Fase de rastreo rápido: googlebot obtiene únicamente el marcado estático en menos de un segundo, sin ejecutar scripts.

- Fase de carga de recursos: descarga JavaScript y CSS, consumiendo presupuesto de rastreo y aumentando la latencia.

- Fase de renderizado tardío: Chromium ejecuta el código, crea contenido dinámico y lo envía al índice.

- Límite de tiempo: superar cinco segundos provoca que el crawler omita por completo el resultado del renderizado dinámico.

Esta mecánica explica por qué una SPA sufre frecuentes problemas de indexación: el enlazado interno solo existe tras el renderizado completo. Si tu html inicial incluye un <div id="root"></div> vacío y surgen errores o demoras, googlebot observa una página sin información relevante durante la primera visita.

Contenido invisible para crawlers: casos comunes

El contenido invisible es el enemigo silencioso del javascript seo. Aparece cuando títulos, descripciones o enlaces existen exclusivamente después de ejecutar eventos click o scroll que los rastreadores no activan. Accordions, pestañas con carga diferida, lazy loading agresivo o módulos importados con code-splitting dejan información oculta a los motores de búsqueda.

Las aplicaciones de una sola página basadas en JavaScript también enfrentan desafíos añadidos: URLs con hash que los buscadores ignoran, discordancia entre servidor y cliente y lentitud inicial que reduce la frecuencia de rastreo. Las soluciones incluyen pre-renderizado con navegadores headless, pushState con rutas limpias y optimización del lazy loading, como se detalla en SEO para SPA.

Verificar qué ve realmente Googlebot en tu sitio

Google Search Console, y en especial la herramienta de inspección de URL, muestra el DOM exacto que Googlebot conserva tras el renderizado dinámico. Compara esa versión con tu html inicial: si faltan encabezados o metadatos, confirma que existe contenido invisible por culpa de JavaScript.

El informe de estadísticas de rastreo dentro de Google Search Console detalla cuántos recursos se descargaron, muestra errores de ejecución y subraya discrepancias en el renderizado javascript. Una vista renderizada con meta noindex inyectada dinámicamente bloqueará la indexación, aunque la página html parezca correcta en el código fuente original.

Cómo detectar y diagnosticar errores de JavaScript SEO

Los problemas de JavaScript no suelen verse a simple vista; por eso requieren herramientas especializadas. Con ellas descubres qué bloquea el rastreo, cuáles recursos no se cargan y dónde aparecen los errores técnicos que impiden una indexación correcta. Sin este análisis será difícil que los buscadores comprendan tu contenido dinámico.

Herramientas de Google para monitorear errores JavaScript

Google Search Console, o simplemente search console, ofrece datos clave sobre cómo procesa tu sitio el googlebot. El informe "Estadísticas de rastreo" muestra errores javascript detectados durante el renderizado, recursos cargados con éxito y el estado final de cada página tras ejecutar código. Si observas picos en "Errores de servidor" o caídas en "Descargas exitosas", enfrentas problemas de JavaScript que debes resolver.

- Inspección de URL: Comparas el html inicial con la versión que ve googlebot después de la ejecución, para detectar diferencias críticas.

- Informe Estadísticas de rastreo: Analiza recursos, errores de consola y el DOM final, ofreciendo un monitoreo javascript completo.

- Informe Cobertura: Señala páginas no indexadas por etiquetas noindex dinámicas o bloqueos surgidos en la ejecución.

Incluir un controlador global onerror captura fallos de ejecución y los envía a sistemas externos. Aunque no detecta errores de sintaxis que impidan la carga total, sí registra fallos en tiempo real que dejan componentes sin renderizar, facilitando la auditoría seo continua.

Identificar recursos bloqueados en robots.txt

El monitoreo javascript también implica revisar que el archivo robots.txt permita el acceso a scripts y estilos. Directivas como Disallow: /js/ impiden que el googlebot descargue código esencial, dejando páginas vacías. El resultado es contenido dinámico invisible y errores de indexación difíciles de rastrear.

- Bloqueo accidental de /js/: Evita directivas Disallow innecesarias sobre carpetas de scripts, ya que frenan el rastreo y el renderizado.

- Bloqueo de archivos.css: El estilo también influye en la ejecución; si el CSS está bloqueado, el renderizado falla.

- Probador de robots.txt en search console: Introduce la URL completa de tu script (por ejemplo, /js/bundle.js) y confirma que figure como "PERMITIDO".

- Redirecciones encadenadas: Reduce saltos 301 en scripts para ahorrar presupuesto de rastreo y acelerar la carga.

Si sirves JavaScript desde dominios externos, añade la cabecera Access-Control-Allow-Origin: *. Sin CORS adecuado, los recursos no se ejecutan y aparecen errores técnicos de renderizado que afectan al javascript seo.

Auditar con Screaming Frog y pruebas manuales

Screaming Frog resulta esencial en cualquier auditoría seo. Activa el modo "Render JavaScript" para rastrear la versión procesada y compara los enlaces detectados con los del html inicial; las diferencias delatan errores. Este enfoque permite descubrir recursos omitidos y problemas de JavaScript antes de que impacten la indexación.

También puedes desactivar JavaScript en el navegador mediante extensiones y revisar la página. Si solo ves un <div id="app"></div> vacío, comprobarás que googlebot percibe lo mismo durante su inspección inicial. Así detectas rápidamente contenido que depende por completo de scripts y planificas soluciones.

Optimizar JavaScript para mejorar Core Web Vitals

Un JavaScript pesado y mal optimizado no solo dificulta la indexación, sino que también ralentiza tu sitio web y perjudica los core web vitals. Un paquete de 500 KB que tarda cinco segundos en ejecutarse reduce significativamente tu posicionamiento web e impacta directamente en el rendimiento SEO.

Cómo JavaScript afecta LCP, INP y CLS

Los core web vitals miden la experiencia real del usuario. El LCP determina cuándo aparece el elemento más grande en pantalla; los scripts ubicados en la cabecera sin atributos async o defer bloquean el análisis del HTML y retrasan esta métrica. El INP mide el tiempo entre una interacción del usuario y la siguiente actualización visual; si el código se ejecuta antes de habilitar la interacción, este valor aumenta y genera frustración. El CLS calcula los desplazamientos inesperados del diseño; un lazy loading sin espacio reservado introduce componentes que mueven el contenido y provocan cambios visuales molestos.

Las páginas con scripts pesados consumen más recursos del presupuesto de rastreo de Googlebot, reduciendo la frecuencia con que visita otras URL importantes. Un sitio de comercio electrónico con paquetes de 300 KB consume casi el doble de recursos comparado con otro optimizado a 80 KB, ralentizando la indexación global del sitio.

| Métrica Core Web Vitals | Impacto de JavaScript | Solución rápida |

| LCP (Largest Contentful Paint) | Scripts en cabecera sin async/defer bloquean el análisis del HTML | Trasladar scripts al final del body; añadir defer para ejecución diferida |

| INP (Input to Next Paint) | Código pesado ejecutándose antes de la interacción genera retrasos elevados | Utilizar requestIdleCallback; trasladar cálculos a Web Workers |

| CLS (Cumulative Layout Shift) | Lazy loading sin espacio reservado provoca saltos visuales | Implementar aspect-ratio CSS; precargar dimensiones de componentes |

Técnicas de carga diferida y code-splitting

La velocidad de JavaScript mejora drásticamente aplicando estrategias simples de carga diferida. El atributo async descarga en paralelo scripts independientes, ideal para analytics.js, mientras que defer permite continuar el análisis del HTML y ejecuta el código antes del evento DOMContentLoaded, perfecto para scripts que modifican el DOM.

- Code-splitting con

import(): Reemplaza un paquete único de 500 KB por módulos separados; 100 KB para la página de inicio, 120 KB para productos y 80 KB para el proceso de pago, cargando únicamente lo necesario en cada página. - Frameworks automatizados: Vite y Next.js dividen automáticamente por rutas. En proyectos tradicionales, genera paquetes independientes con Webpack o Rollup y reduce el peso inicial de 500 KB a menos de 100 KB.

- Lazy loading de componentes: Combina el code-splitting con

deferen scripts de terceros, como chats o anuncios, para evitar bloqueos durante la primera carga crítica.

Minificar y comprimir JavaScript mediante Terser o Uglify reduce un paquete de 150 KB a menos de 60 KB, mejorando el First Contentful Paint. Incluir Critical CSS en línea muestra el contenido principal antes de que el JavaScript completo se ejecute, fortaleciendo la percepción de rapidez.

Comprimir y servir JavaScript desde CDN

Servir JavaScript a través de un CDN con distribución geográfica reduce la latencia; un usuario en Buenos Aires no debería descargar el paquete desde Europa. Activar HTTP/2 o HTTP/3 permite múltiples solicitudes simultáneas y acelera la entrega de código y recursos relacionados.

Gzip reduce el tamaño del JavaScript entre un 30-40 % del original, mientras que Brotli alcanza un 20-25 %. Asegúrate de que el servidor envíe Content-Encoding: gzip y aplica Cache-Control: max-age=31536000; así reutilizas archivos entre visitas, mejoras la velocidad de carga en visitas recurrentes y refuerzas el rendimiento SEO en motores de búsqueda.

Soluciones de renderizado para sitios JavaScript

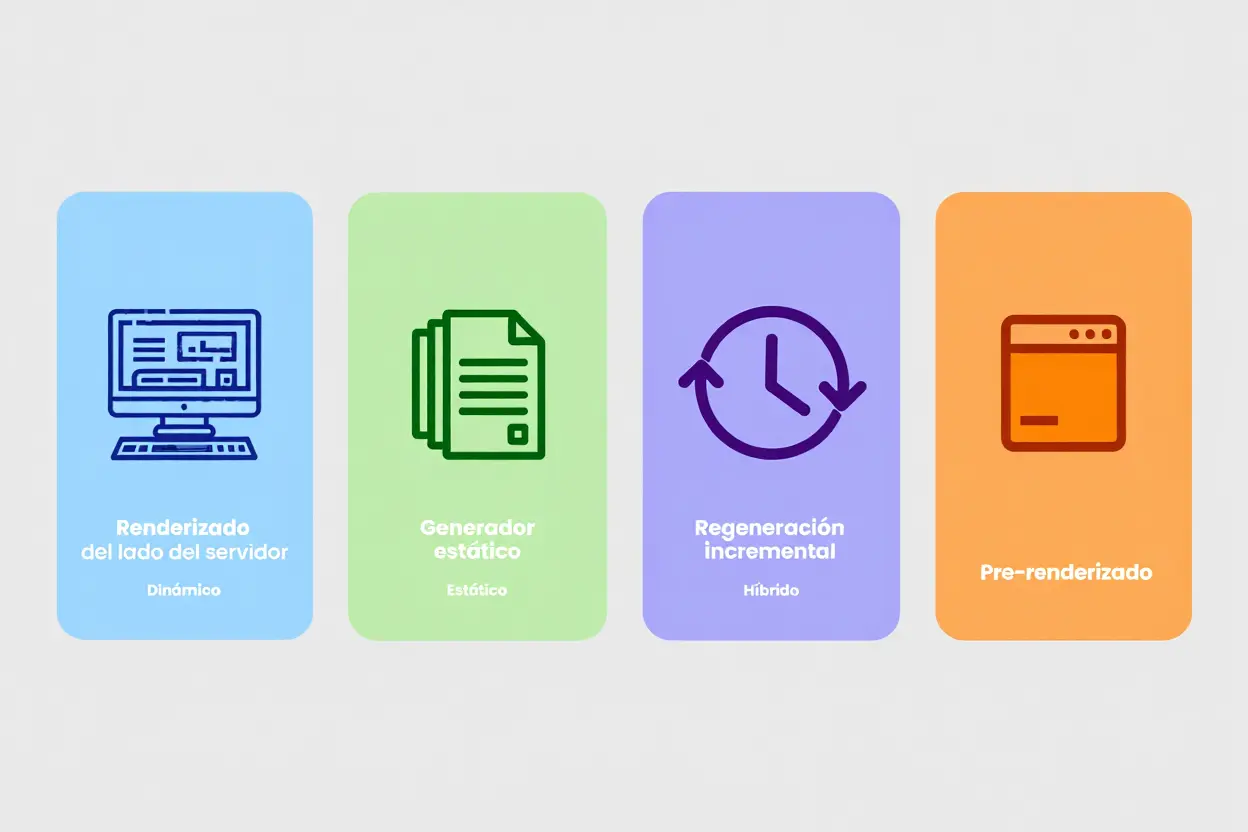

Existen diversas estrategias que resuelven eficazmente los problemas de JavaScript, garantizando que Google indexe tu contenido dinámico sin problemas. La elección óptima depende de la arquitectura de tu sitio, el volumen de páginas y el presupuesto de desarrollo disponible para implementar los ajustes necesarios.

Server-Side Rendering vs Static Site Generation

Con Server-Side Rendering (SSR), el servidor genera el HTML inicial completo antes de enviarlo al navegador, permitiendo que Googlebot acceda inmediatamente a todo el contenido. Este método favorece un rastreo rápido y confiable, aunque añade carga a la infraestructura y puede incrementar los costes operativos.

Por su parte, Static Site Generation (SSG) crea archivos HTML durante la fase de compilación, resultando ideal para blogs, páginas de destino o catálogos que experimentan cambios ocasionales. Ofrece máxima velocidad y libera al servidor, pero cualquier actualización relevante requiere reconstruir el proyecto, lo que resulta poco práctico en escenarios con miles de productos que cambian a diario.

La Incremental Static Regeneration (ISR) combina ambas técnicas: Next.js sirve versiones estáticas desde la CDN y regenera páginas en segundo plano cuando detecta modificaciones. Esta estrategia ofrece el rendimiento de un sitio estático con contenido actualizado sin necesidad de recompilar todo el proyecto, siendo perfecta para e-commerce con inventario variable.

Prerenderizado para crawlers sin penalizaciones

Si tu plataforma es una SPA pura y migrar a SSR o SSG no es factible a corto plazo, implementa el prerenderizado específicamente para crawlers. Servicios como Rendertron o Prerender.io detectan cuando Googlebot visita tu sitio y le muestran una versión completamente renderizada, mejorando así el SEO de SPA sin incurrir en cloaking ni afectar la experiencia interactiva del usuario.

URLs limpias y enlaces nativos para bots

Las URLs con hash (#/ruta/pagina) son una reliquia de la era AJAX y los buscadores ya no las gestionan adecuadamente. Implementa History API con pushState para generar URLs limpias que los bots puedan descubrir fácilmente, evitando pérdidas de rastreo y problemas de JavaScript inesperados.

- Enlaces HTML nativos: Incluye elementos

<a href="/ruta">Texto</a>directamente en el HTML inicial; los bots no activan eventosclick()para descubrir nuevas páginas. - Paginación tradicional: Sustituye el scroll infinito por enlaces convencionales (

<a href="/pagina/2">) para asegurar que Googlebot rastree todas las secciones. - Etiquetas canónicas: Apunta la etiqueta canonical a la versión limpia de la URL para prevenir contenido duplicado originado por parámetros dinámicos.

Incorpora datos estructurados JSON-LD directamente en el <head> del HTML inicial. Si los insertas mediante JavaScript, es posible que no se muestren durante el primer rastreo. Este enfoque permite a los buscadores procesar desde el inicio tu marcado de producto, organización o reseñas, enriqueciendo así los resultados de búsqueda.

Validar que JavaScript no bloquea tu indexación

La teoría siempre ayuda, pero resulta fundamental verificar tu sitio de manera específica y periódica. Existen pruebas muy sencillas y herramientas gratuitas que te permiten confirmar si JavaScript está perjudicando tu rastreo y tu SEO sin que te des cuenta.

Comprobar indexación de contenido JavaScript en Google

La validación SEO JavaScript comienza con búsquedas rápidas. Ejecuta el comando site:tudominio.es "fragmento de texto" directamente en el buscador de Google o utiliza Google Search Console para verificar si ese párrafo, generado únicamente mediante contenido JavaScript, aparece indexado. Si el texto no figura en los resultados, significa que los buscadores no procesaron correctamente la página.

- Comando site: avanzado: Utiliza

site:tudominio.es "texto único de JavaScript"para comprobar instantáneamente si ese contenido dinámico se encuentra dentro del índice de Google. - Vista renderizada en Search Console: Inspecciona la URL en Search Console, selecciona "Ver página renderizada" y compara la versión servida con la inicial; si faltan elementos clave, Googlebot no ejecutó correctamente el script.

- Caché de Google: Ejecuta

cache:tudominio.es/pagina; si el HTML aparece prácticamente vacío, mostrando apenas<div id="app">, Google tampoco procesó el JavaScript.

El informe "Cobertura" de Google Search Console lista las páginas excluidas. Haz clic en "Excluido" y revisa si alguna quedó marcada como noindex insertado dinámicamente, lo cual indica que un script agregó la metaetiqueta después de la carga inicial.

Verificar acceso a recursos en robots.txt

El testing JavaScript aplicado a robots.txt requiere menos de dos minutos y puede descubrir bloqueos críticos. Abre Google Search Console, accede a "Configuración" → "Probador de robots.txt" e introduce la ruta completa de tu script, por ejemplo /js/app.js o /assets/bundle.123abc.js; si el sistema responde PERMITIDO, todo funciona correctamente, pero un estado BLOQUEADO confirma el origen del problema de rastreo.

- Verificación amplia: Examina varios recursos: archivos

.js,.cssy directorios completos como/assets/o/static/. - User-agent específico: Muchos archivos robots.txt restringen únicamente ciertos bots; prueba también con

User-agent: Googlebot-Mobilepara asegurar compatibilidad móvil. - Redirecciones: Verifica que los scripts no terminen en cadenas de redirecciones 301-302 prolongadas, ya que consumen presupuesto de rastreo innecesariamente.

- Encabezados X-Robots-Tag: Asegúrate de que ningún archivo del directorio

/js/devuelvaX-Robots-Tag: noindex, lo que bloquearía su indexación.

Confirma en la pestaña Network de Chrome DevTools que los recursos JavaScript respondan con código 200. Un error 403 indica permisos incorrectos y un 404 señala que el archivo fue movido o eliminado; ambas situaciones impiden que Googlebot complete el renderizado correctamente.

Testing con Chrome DevTools y Search Console

Abre Chrome DevTools (F12), selecciona "Performance" y graba la carga de la página; si observas un pico significativo de ejecución antes del primer render, estarás ante un problema de LCP que conviene optimizar. En la sección "Coverage" podrás identificar qué código nunca se ejecuta: elimínalo o divídelo en bundles separados para mejorar la validación SEO JavaScript.

La pestaña "Network" resulta crucial para auditar el peso y el estado de cada recurso. Asegúrate de que todos los archivos .js y .css devuelvan código 200 y que ningún bundle inicial supere los 500 KB; dividir los paquetes reduce tiempos de carga y facilita el rastreo de Google, mejorando así la indexación de tu contenido dinámico en los buscadores.