Une checklist SEO technique exhaustive vous permet d'identifier rapidement les défaillances de votre site et d'améliorer son positionnement sur Google. Elle couvre les points essentiels, vitesse de chargement, sécurité https, indexation, structure des url, maillage interne, balises HTML et adaptation mobile, autant de domaines critiques pour que les moteurs de recherche explorent, indexent et classent correctement votre site. Vous découvrirez aussi comment Sedestral automatise ce processus via son agent Nox, transformant l'audit technique en tâche simple et récurrente.

Checklist SEO : pourquoi une liste de contrôle est indispensable

Une liste de contrôle seo structure votre démarche d'optimisation et vous aide à ne rien oublier. Sans elle, on risque de corriger des détails mineurs tout en laissant des problèmes critiques freiner votre visibilité organique. Les moteurs de recherche évaluent plusieurs dimensions techniques pour indexer et classer votre site, une approche méthodique devient alors indispensable.

Mettre en place une checklist seo technique signifie aussi prioriser vos efforts : certains problèmes bloquent complètement l'indexation, erreurs 5xx massives, robots.txt mal configuré, tandis que d'autres réduisent simplement votre classement, comme les images non optimisées ou les balises manquantes. Comprendre cette hiérarchie vous permet d'agir vite sur ce qui compte vraiment. Pour aller plus loin, une checklist SEO technique de référence peut compléter votre propre liste de contrôle.

Définition d'une checklist seo technique complète

Une checklist seo technique regroupe tous les points à vérifier pour s'assurer que votre site répond aux standards techniques de Google. Elle couvre la vitesse de chargement, la sécurité, l'indexation, la structure des pages, le mobile et l'expérience utilisateur, autant de facteurs qui influencent directement votre référencement naturel et votre positionnement dans les résultats.

Cette liste évolue avec les mises à jour de Google et les nouvelles technologies web. L'important est de disposer d'un référentiel stable que vous appliquez régulièrement, idéalement une fois par mois ou après chaque modification majeure de votre site.

Les 4 piliers du référencement et la place du technique

Le SEO repose sur quatre piliers : la technique, crawl, indexation, performance —, le contenu, la popularité via backlinks et l'expérience utilisateur. Notre checklist SEO technique se concentre sur le premier pilier, car la dimension technique conditionne l'accès des moteurs de recherche à votre contenu. C'est souvent la première à corriger.

- Technique (crawl et indexation) : assure que Google peut explorer et indexer vos pages sans obstacle, redirections, robots.txt, sitemap, codes HTTP.

- Contenu et sémantique : garantit que votre message est clair, pertinent et structuré pour les algorithmes, balises HTML, données structurées, mots-clés.

- Popularité et autorité : renforce votre crédibilité via des backlinks de qualité, citations et mentions de votre marque dans l'écosystème web.

- Expérience utilisateur : satisfait les visiteurs et Google, vitesse, mobile, accessibilité, clarté de la navigation sur votre site.

Sans une base technique saine, même un contenu excellent ne sera pas correctement indexé ni positionné. Un site rapide, sécurisé et bien structuré offre les fondations nécessaires pour que vos efforts de référencement portent leurs fruits. Pensez aussi à explorer l'audit SEO technique et l'analyse logs SEO pour compléter votre approche.

Quand et à quelle fréquence appliquer cette liste de contrôle

Appliquez votre checklist technique seo lors du lancement de votre site, après chaque migration ou refonte majeure, et de façon régulière, idéalement tous les deux mois pour maintenir un niveau d'optimisation constant. Les problèmes émergent régulièrement : mises à jour serveur, changements de plugins, migrations d'hébergement, autant de moments qui justifient un audit technique rapide.

Audit du crawl, du sitemap et de l'indexation du site

Un audit SEO technique commence par un scan exhaustif de votre site, récupérer toutes les URL, les codes HTTP, les balises meta et les titres pour comprendre l'état réel de votre présence en ligne. Screaming Frog et Google Search Console sont vos deux alliés principaux pour ce diagnostic de crawl indexation.

Scanner le site avec Screaming Frog et Google Search Console

Lancez Screaming Frog sur votre site pour générer une cartographie complète : cet outil d'audit SEO technique vous montre chaque URL, son statut HTTP, ses balises title, meta descriptions, balises H1 et images. On identifie immédiatement les pages sans balises critiques, les redirections mal configurées et les erreurs page 404 qui grignotent inutilement votre budget de crawl.

- Codes de réponse HTTP : vérifiez que vos pages importantes retournent 200, que les redirects sont 301 et non 302, et que les erreurs restent sous 1 % de votre site.

- Balises title et meta descriptions : chaque page doit posséder un title unique (50-60 caractères) et une meta description (155-160 caractères), Screaming Frog signale les doublons et les balises manquantes.

- Balises H1 et hiérarchie : une seule H1 par page, suivie d'une hiérarchie logique H2/H3, cet ordre aide Google à comprendre la structure de votre contenu sur le site.

- Attributs alt sur images : chaque image doit posséder un alt descriptif, Screaming Frog identifie rapidement les images orphelines et permet d'optimiser votre site pour la recherche visuelle.

Complétez ce scan avec la Search Console : consultez le rapport Couverture pour voir quelles pages Google a découvertes, indexées, exclues ou bloquées. Les erreurs y sont triées par type, 4xx, 5xx, redirections bloquées, pour une correction ciblée et efficace du site.

Les pages orphelines, sans aucun lien interne, ne peuvent pas être découvertes efficacement par les robots de crawl. Sedestral identifie ces pages isolées et vous propose de les relier au maillage interne pour assurer leur indexation et leur visibilité sur votre site.

Vérifier le robots.txt et le sitemap XML

Le fichier robots.txt et le sitemap XML orchestrent la façon dont Google explore votre site, leur configuration optimale est essentielle pour guider le crawl indexation et maximiser votre budget d'exploration. Un robots.txt mal configuré peut bloquer accidentellement des pages essentielles, tandis qu'un sitemap obsolète crée de la confusion auprès des moteurs de recherche.

- Présence et localisation : robots.txt doit être présent à la racine de votre site (exemple.com/robots.txt) et accessible via Google Search Console, l'absence totale de ce fichier signale une configuration minimale mais pas optimale.

- Autorisations critiques : assurez-vous que robots.txt n'auto-bloque pas les fichiers CSS, JavaScript et images essentiels au rendu, si vous les bloquez, Google ne peut pas évaluer votre site correctement.

- Sitemaps XML : incluez une référence au sitemap dans robots.txt (Sitemap: https://exemple.com/sitemap.xml) et maintenez un sitemap propre, excluant les pages redirigées, les erreurs page 404 et les doublons canonisés.

- Blocage des sections à faible valeur : si certains paramètres URL créent des doublons, exemple : ?couleur=rouge, ?taille=L, bloquez-les via robots.txt ou utilisez les balises canoniques pour éviter que votre budget de crawl ne soit gaspillé.

Examinez régulièrement votre configuration via Google Search Console, onglet « Paramètres d'exploration », et vérifiez que votre sitemap est à jour. Sedestral propose un rapport spécifique sur la configuration robots.txt et sitemap, signalant les erreurs de syntaxe et les ressources critiques bloquées involontairement.

Les faux crawlers peuvent aussi consommer votre budget d'exploration : vérifiez le user-agent contre le DNS inverse pour éliminer les imposteurs se faisant passer pour Googlebot. Cette vérification simple protège votre site et assure que votre budget de crawl profite réellement à Google.

Identifier les erreurs HTTP et les pages non indexables

Les erreurs HTTP, page 404, 5xx, 401, 403, freinent l'indexation de votre site et dégradent l'expérience utilisateur. Une URL morte renvoie une page 404; une erreur 5xx incite Google à réduire sa fréquence de crawl sur votre site.

Dès que les erreurs 5xx dépassent 2 % de vos requêtes Googlebot, déclenchez un audit technique urgent, ce seuil signale une instabilité d'infrastructure pouvant entraîner une déindexation progressive de votre site. Consultez vos logs serveur pour identifier la cause racine : surcharge, timeout ou erreurs de configuration.

Les chaînes de redirection, A → B → C au lieu de A → C, consomment inutilement votre budget de crawl et ralentissent l'accès à votre contenu : simplifiez chaque redirection pour qu'elle pointe directement vers sa destination finale en HTTPS. Redirigez également les erreurs page 404 vers un contenu pertinent pour réduire les pertes de crawl et améliorer l'expérience utilisateur sur votre site.

Core Web Vitals et optimiser la vitesse de chargement

Depuis 2021, les Core Web Vitals de Google définissent précisément ce que signifie « rapide » pour votre site. Ces trois métriques, LCP, INP et CLS, mesurent la performance réelle perçue par l'utilisateur et influencent directement votre référencement technique ainsi que votre position dans les résultats.

LCP, INP et CLS : les métriques du référencement technique

Les core web vitals sont trois signaux de performance imposés par Google : le LCP (Largest Contentful Paint), l'INP (Interaction to Next Paint) et le CLS (Cumulative Layout Shift). Chacun mesure un aspect différent de l'expérience utilisateur, temps de chargement perçu, réactivité, stabilité visuelle, et contribue à l'évaluation globale de votre site par les algorithmes.

Le LCP mesure le délai avant l'affichage de l'élément principal visible : il doit rester sous 2,5 secondes. L'INP évalue la réactivité de votre site aux clics et interactions, avec un seuil de 200 ms à ne pas dépasser. Le CLS, lui, mesure la stabilité visuelle, tout décalage inattendu de contenu pendant le chargement doit être minimisé.

| Métrique | Seuil « Bon » | Cause principale |

| LCP (chargement) | < 2,5 secondes | Images surdimensionnées, CSS/JS bloquant, TTFB lent |

| INP (réactivité) | < 200 ms | Tâches JavaScript longues, widgets tiers lourds |

| CLS (stabilité) | < 0,1 | Images/vidéos sans dimensions, chargement différé non prévu |

Outils pour mesurer et corriger les performances

Google PageSpeed Insights et l'audit technique de Sedestral mesurent vos core web vitals sur mobile et desktop, c'est directement votre référencement qui en dépend. Ces outils identifient précisément ce qui ralentit votre site et proposent des corrections priorisées selon leur impact potentiel.

L'agent Nox de Sedestral automatise cette mesure en continu : il teste régulièrement vos core web vitals, alerte en cas de dégradation et signale les sections les plus problématiques. Vous bénéficiez ainsi d'un suivi permanent qui réagit aux anomalies avant qu'elles ne nuisent à votre trafic organique.

Techniques concrètes pour réduire le temps de chargement

Optimiser le LCP et améliorer les core web vitals repose sur quelques actions essentielles : compression d'images, mise en cache, déférage de scripts et optimisation du serveur. Leur combinaison produit des gains mesurables et immédiats sur votre site.

- Optimiser les images : convertissez-les au format WebP (30 à 50 % de réduction) et assurez-vous qu'elles correspondent à la taille d'affichage, une image 4000×3000 affichée à 400×300 ralentit inutilement votre site.

- Activer la mise en cache navigateur : configurez les en-têtes HTTP pour que les navigateurs conservent en mémoire vos ressources statiques, les visites répétées chargeront instantanément votre site.

- Implémenter un CDN : si votre LCP dépasse 2,5 secondes, un Content Delivery Network rapproche votre contenu géographiquement de vos utilisateurs, réduisant la latence réseau.

- Différer les scripts non essentiels : chargez les JavaScript tiers (analytics, publicités, chat) de manière asynchrone ou différée pour libérer le thread principal et accélérer le rendu initial de votre site.

Activez la compression GZIP ou Brotli sur votre serveur pour réduire la taille des fichiers texte transmis, un geste simple qui améliore notablement la performance. Optimisez vos polices web avec font-display: swap pour éviter le délai avant l'affichage du texte, et vérifiez que votre temps de réponse serveur (TTFB) ne dépasse pas 2 secondes : un délai supérieur réduit directement la fréquence de crawl de Googlebot sur votre site.

HTTPS, URL et balises canoniques pour le référencement

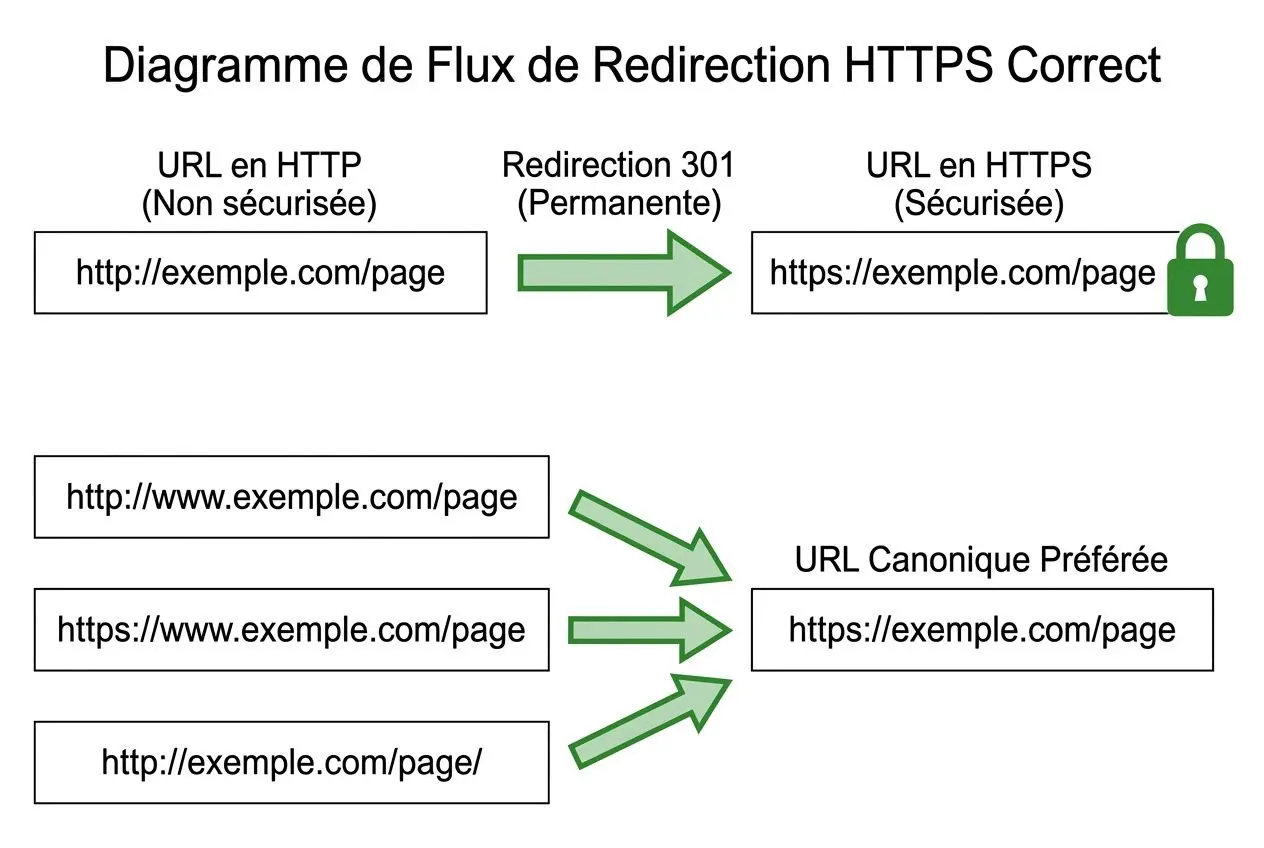

Depuis 2014, le HTTPS est un signal de classement officiel : il chiffre les communications, protège vos visiteurs et renforce votre crédibilité auprès de Google. Gérer les URL dupliquées via des balises canoniques évite que Google ne gaspille son budget de crawl sur plusieurs versions identiques de votre contenu.

Sécuriser son site avec HTTPS et un certificat SSL valide

La https sécurité repose sur un certificat SSL valide qui chiffre les échanges entre votre serveur et les navigateurs de vos visiteurs. Le cadenas visible dans la barre d'adresse rassure vos visiteurs et signale à Google que votre site est digne de confiance.

- Installation d'un certificat SSL valide : demandez un certificat auprès de votre hébergeur ou d'une autorité de certification reconnue, la plupart des offres modernes incluent Let's Encrypt gratuitement.

- Redirections HTTP vers HTTPS : configurez des redirections permanentes 301 depuis toutes vos pages HTTP vers leurs équivalentes HTTPS, cette étape est indispensable pour migrer votre autorité et préserver votre référencement.

- Éliminer le contenu mixte : vérifiez qu'aucune ressource (images, CSS, JavaScript) ne se charge encore via HTTP sur votre site HTTPS, le contenu mixte génère des avertissements dans les navigateurs et nuit à la confiance.

- Mettre à jour les liens internes : remplacez tous les liens internes pointant vers HTTP par des liens HTTPS, une étape souvent oubliée, pourtant essentielle pour éviter les redirections en chaîne au sein de votre site.

Vérifiez votre migration via Google Search Console : consultez les paramètres du domaine et assurez-vous que Google crawle bien votre version HTTPS. Une migration mal exécutée peut coûter plusieurs semaines de trafic, prenez le temps de planifier et de tester chaque redirection.

Gérer les URL dupliquées et les balises canoniques

Les balises canoniques url permettent d'indiquer à Google l'URL préférée d'une page lorsqu'il existe des doublons. Sans cette indication, Google pourrait indexer plusieurs versions du même contenu, diluant votre autorité et consommant votre budget de crawl inutilement. Chaque page importante de votre site doit posséder une balise canonique cohérente.

- Balises canoniques cohérentes : chaque page pointe vers elle-même (auto-canonical) ou vers l'URL préférée, elles doivent être absolues (https://exemple.com/page) et stables dans le temps.

- Déclaration du domaine préféré : choisissez une version unique de votre domaine (www ou non-www, HTTPS obligatoire) et déclarez-la via redirection 301, balises canoniques et la search console.

- Hreflang pour les sites multilingues : si votre site existe en plusieurs langues, utilisez hreflang pour que Google serve la bonne version à chaque utilisateur, ce balisage évite les pénalités pour contenu dupliqué inter-langues.

Vérifiez vos balises dans le code source en recherchant « rel=canonical » : elles doivent être présentes et correctes sur chaque page stratégique. Sedestral détecte automatiquement les balises canoniques manquantes ou malformées, pour que vous puissiez corriger votre site rapidement.

Architecture des URL et profondeur de navigation

Vos URL doivent être courtes, descriptives et contenir les mots-clés pertinents, une URL claire aide Google à comprendre le sujet de votre page. Évitez les paramètres superflus, les caractères spéciaux et les profondeurs excessives qui ralentissent la découverte et le crawl de votre contenu.

Limitez la profondeur de navigation à trois clics maximum depuis la page d'accueil pour atteindre vos pages stratégiques : au-delà, certaines pages deviennent invisibles pour Google et perdent leurs chances de classement. Veillez également à utiliser correctement les codes HTTP, 200 pour les pages valides, 301 pour les redirections permanentes, 404 pour les pages supprimées, cette rigueur aide Google à gérer intelligemment votre site et votre budget de crawl.

Checklist SEO pour le mobile, les balises et données structurées

Depuis l'Index Mobile-First, la version mobile de votre site sert de référence pour l'indexation et le classement, une optimisation mobile irréprochable n'est plus une option. Les données structurées et les balises HTML bien configurées aident Google à comprendre précisément votre contenu, ce qui améliore votre visibilité et votre taux de clic dans les résultats de recherche.

Optimiser le site pour l'index mobile-first de Google

L'optimisation mobile ne signifie plus produire une version allégée de votre site : on adopte un design responsive où le contenu, les liens internes et les balises HTML restent identiques entre mobile et desktop. C'est la condition sine qua non pour réussir sous l'Index Mobile-First de Google, qui utilise votre version mobile pour l'indexation et le classement.

Testez votre site via Google Mobile-Friendly Test et Lighthouse, ces outils détectent les problèmes de viewport, de boutons trop petits et de textes tronqués. Corriger un bouton trop petit peut suffire à doubler votre taux de conversion mobile. Chaque problème identifié est une opportunité concrète d'amélioration.

- Design responsive : utilisez des media queries CSS pour adapter votre mise en page à tous les écrans, c'est l'approche recommandée par Google.

- Viewport correctement configuré : ajoutez la balise meta viewport (width=device-width, initial-scale=1) pour que les navigateurs mobiles affichent votre site à la bonne taille.

- Lazy-loading des images : chargez les images uniquement lorsqu'elles entrent dans la fenêtre d'affichage, cette technique réduit le poids initial de la page et améliore le LCP mobile.

- Navigation tactile : vérifiez que les boutons et liens sont assez grands pour être cliqués au doigt, la recommandation est de 48×48 pixels minimum.

Mesurez l'impact de vos optimisations mobiles via Google Search Console : l'onglet Performances affiche vos impressions, clics et CTR sur mobile. Une meilleure expérience mobile se traduit rapidement par une hausse du trafic. Continuez à optimiser et à tester pour garder votre site compétitif.

Implémenter les données structurées Schema.Org

Les données structurées s'appuient sur le balisage Schema.org pour aider Google à comprendre votre contenu et afficher des rich snippets, étoiles, prix, disponibilité, dans les résultats de recherche. Ces informations enrichies augmentent votre visibilité et votre taux de clic, un avantage réel face aux concurrents qui n'en utilisent pas.

- Article (pour blog) : balisez vos articles avec title, datePublished, author et image pour que Google affiche un aperçu riche.

- Product (pour e-commerce) : déclarez le prix, la disponibilité, les avis et les évaluations pour renforcer votre présence dans les résultats produits.

- LocalBusiness (pour professionnels) : balisez votre adresse, téléphone, heures d'ouverture et avis clients pour dominer votre marché local.

- BreadcrumbList, FAQPage, HowTo : utilisez ces schémas selon votre contenu pour améliorer la compréhension et l'affichage de votre site dans les résultats de recherche.

Validez vos données structurées avec l'outil d'inspection des résultats enrichis de Google, il détecte les erreurs et avertissements qui bloquent l'affichage correct de vos rich snippets. Une implémentation rigoureuse peut augmenter votre CTR de 20 à 30 %, à condition de maintenir une vigilance constante sur votre site.

Balises HTML, W3C et suivi continu du référencement technique

La hiérarchie des balises, H1 unique, H2, H3, title, meta description, attributs alt, structure le sens de votre contenu pour les moteurs de recherche. Une H1 manquante ou plusieurs H1 sur la même page brouillent la lecture de Google; des balises alt vagues réduisent votre visibilité en recherche visuelle. La conformité HTML/CSS aux normes W3C garantit qu'aucune erreur de balisage ne perturbe le rendu ou l'interprétation de votre site.

Mettez en place des tableaux de bord et des alertes automatisées via Google Search Console et Sedestral : vous êtes notifié immédiatement en cas de chute de trafic, de nouvelles erreurs ou de dégradation des core web vitals. Cette approche transforme votre audit SEO en processus continu, bien plus efficace qu'une tâche ponctuelle, et maintient votre site toujours prêt à performer. C'est ainsi qu'on optimise durablement sa performance et son référencement technique.