Un problème d'indexation Google survient lorsque vos pages n'apparaissent pas dans les résultats de recherche. Cela prive votre site d'un trafic organique précieux. Diagnostiquer les causes et les corriger passe par un audit technique SEO complet.

Comment savoir si votre site a un problème d'indexation

Les signaux d'une indexation défaillante sont rapidement identifiables : une chute soudaine du trafic ou la disparition de pages stratégiques. Bien que complexe, l'origine du problème est toujours identifiable.

Les signaux d'alerte d'une page non indexée

Une simple recherche textuelle dans le moteur révèle les absences suspectes. C’est une technique pour vérifier si un site est non indexé partiellement ou totalement.

- Baisse du trafic SEO : une chute brutale des visiteurs signale souvent une désindexation.

- Pages stratégiques manquantes : vos meilleurs contenus n’apparaissent plus dans l’index.

- Absence de résultats pour votre marque : si le moteur ignore votre nom, c’est une erreur critique.

Ces signes confirment un défaut technique. Une intervention rapide permet de préserver votre visibilité.

Utiliser Google Search Console pour un premier rapport

Google Search Console est l'outil officiel pour identifier ces problèmes. Son rapport indique le volume de pages indexées et celles exclues.

Dans la section dédiée, un tableau récapitule chaque URL concernée par une anomalie. On y trouve les éléments exclus par noindex, les doublons ou les défauts de serveur. L’outil détaille les raisons de la non-indexation.

L’outil d'inspection de la plateforme permet d'étudier l'état précis d'une adresse web. Il indique si le robot peut effectuer son crawl sans blocage et si la ressource subit une directive restrictive.

Vérifier rapidement l'indexation d'une URL précise

L'analyse directe offre un diagnostic immédiat après avoir collé votre adresse. Le système affiche le statut actuel : ressource bloquée ou en attente d'exploration. Les obstacles, comme un JavaScript défaillant, sont clairement listés.

Certains logiciels analysent plusieurs adresses simultanément. Le croisement de ces données permet d'obtenir une vision technique exhaustive et de garantir la fiabilité du diagnostic.

Les erreurs techniques qui bloquent l'indexation de vos pages

Un problème d'indexation cache souvent des erreurs techniques précises, comme un fichier mal paramétré. Identifier la source du problème est crucial pour régler la situation efficacement et durablement.

Robots.txt et directives noindex, les blocages invisibles

Une configuration incorrecte de votre fichier robots.txt empêche Google d'explorer certaines parties de votre site. Cela engendre une erreur d'indexation et bloque la lecture. Corrigez ce fichier pour permettre à Googlebot de reprendre son exploration.

La présence d'une méta directive noindex bloque toute tentative d'indexation, même si la page reste consultable. De même, une balise canonical défaillante peut renvoyer par erreur vers une mauvaise URL. Le moteur est alors induit en erreur et indexe le mauvais contenu.

Erreurs serveur et redirections problématiques

Les codes d'erreur 404 ou 500 rendent une URL inaccessible, stoppant l'activité des robots. Ce type de blocage signifie que le moteur ne peut plus accéder à votre contenu. Rétablissez ces pages manquantes pour faciliter leur ajout à l'index.

Les chaînes de redirections ralentissent considérablement le budget de crawl alloué à votre site. Le robot peut abandonner en route, et la page visée n'est finalement jamais indexée. Simplifiez ces parcours en privilégiant une redirection directe et unique.

Balise canonical mal configurée et contenu JavaScript

Un attribut canonical erroné trompe le moteur, qui peut alors ignorer le contenu que vous souhaitiez promouvoir. De plus, un texte généré dynamiquement en JavaScript n'est pas toujours correctement exploré. Vérifiez ces aspects pour éviter de pénaliser vos pages.

Sur de nombreux CMS, des réglages par défaut demandent aux moteurs de ne pas indexer le contenu. Vérifiez vos paramètres de visibilité dans l'admin. C'est une cause fréquente qui empêche Google d'indexer vos pages.

Diagnostiquer un problème d'indexation avec le bon rapport

Repérer un problème d'indexation nécessite de s'appuyer sur les bons outils et les données pertinentes. La Google Search Console reste la source d'information officielle et primordiale. Obtenir un rapport d'indexation exhaustif demande toutefois une inspection technique poussée.

Le rapport de couverture dans Google Search Console

Le rapport de couverture offre une vision d'ensemble immédiate pour votre site. Il liste le nombre de pages indexées, les différents avertissements et les contenus exclus. Chaque partie détaille les raisons des anomalies et propose des corrections concrètes.

- Pages indexées : Ce statut confirme que vos contenus sont bien dans l'index principal.

- Erreurs : Il s'agit souvent d'une erreur serveur ou d'un blocage qui empêche le crawl.

- Pages exclues : Ces URL sont généralement écartées par une balise noindex ou des redirections.

- Avertissements : Ces signaux n'empêchent pas l'indexation, mais ils impactent la qualité perçue.

Cette vue synthétique s'enrichit de listes détaillées pour chaque statut. Vous pouvez y examiner chaque URL concernée individuellement. L'export de ces données est également possible pour valider vos futures corrections.

| Catégorie | Nombre de pages | Action recommandée |

| Pages indexées | Vise le maximum possible | Surveiller pour éviter les baisses |

| Erreurs serveur (5xx) | Doit être 0 | Corriger immédiatement l'hébergement |

| Erreurs client (4xx) | Doit être minimal | Corriger les urls cassées ou redirections |

| Pages exclues (noindex) | Intentionnel | Vérifier que c'est voulu |

Consultez ce rapport chaque semaine pour détecter rapidement toute variation anormale. Une chute soudaine du nombre de pages indexées signale souvent un nouveau dysfonctionnement. Une hausse des codes 4xx indique par exemple la création de liens brisés.

Inspecter une URL précise pour comprendre le blocage

Pour comprendre une anomalie précise, utilisez la fonction Inspecter l'URL. En quelques secondes, l'outil affiche la dernière date d'exploration et le type de crawleur utilisé. Il révèle aussi tout blocage qui freine les robots.

Si la page n'est pas indexée, la console en explique clairement la cause, comme un contenu dupliqué ou un script mal exécuté. Cette transparence permet de résoudre la situation sans ambiguïté.

Automatiser le diagnostic avec un outil d'audit technique

Les données officielles sont parfois limitées, sans suivi continu ni alertes en temps réel. Un outil d'audit automatique analyse en profondeur votre sitemap et vos balises. Il identifie en continu toutes les adresses inaccessibles ou ignorées.

Ce type de solution génère un rapport détaillé avec des recommandations priorisées. Il met en avant les problèmes critiques qui nuisent à l'indexation Google de vos pages. La détection en temps réel vous aide à agir avant de perdre du trafic.

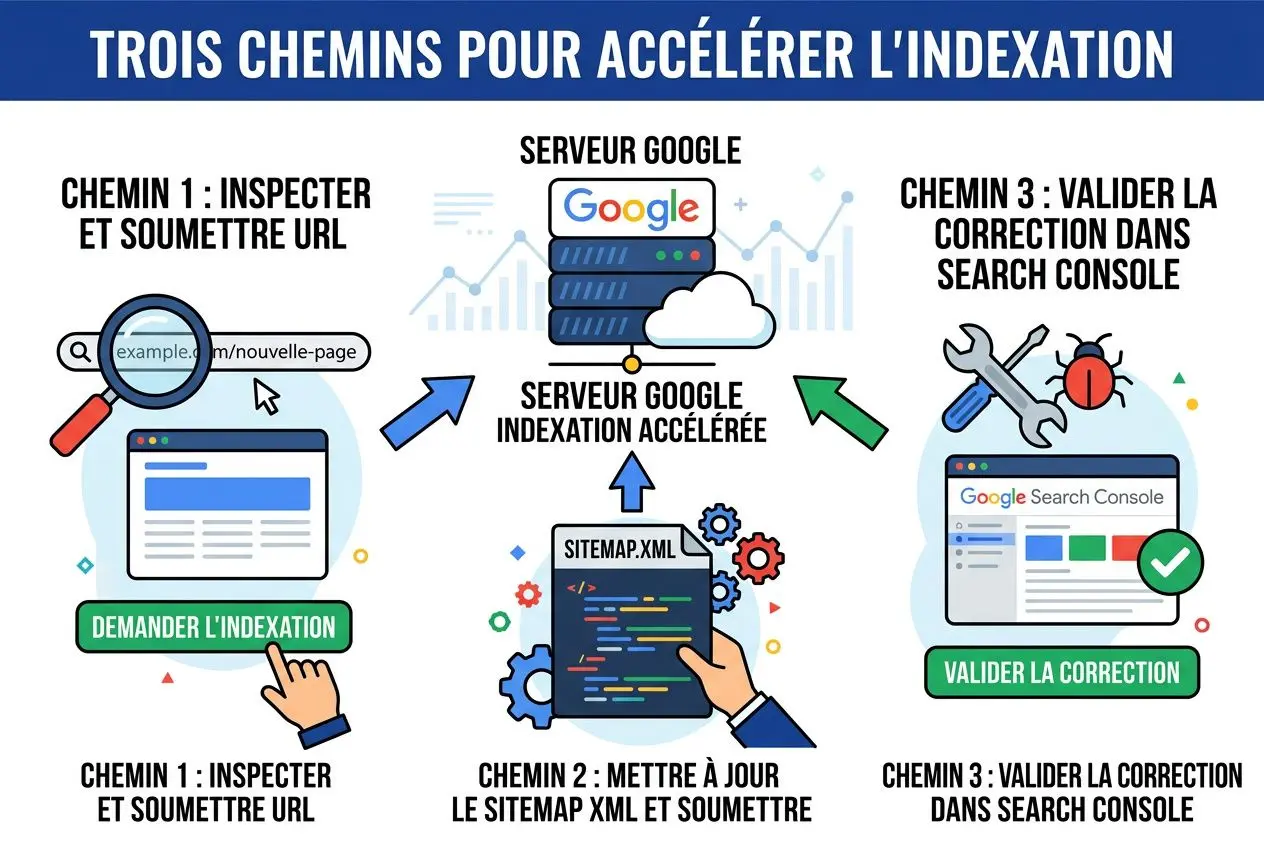

Comment demander l'indexation d'une URL corrigée sur Google

Une fois les problèmes techniques résolus, signalez ces corrections pour accélérer leur réévaluation. Plusieurs méthodes permettent d'accélérer l'indexation par Google. Vous pouvez opter pour la soumission directe, l'actualisation du sitemap ou la validation officielle.

Soumettre une URL via l'outil d'inspection de Search Console

Ouvrez l'outil d'inspection de Google Search Console, saisissez votre url et testez-la en direct. Si aucune erreur n'apparaît, demandez l'indexation. Google placera l'adresse dans une file d'attente prioritaire d'exploration pour accélérer son crawl. Cette méthode est la plus rapide pour une page spécifique.

- Test en direct : Google examine la page immédiatement pour vérifier le fonctionnement de la correction.

- Demande d'indexation : l'url rejoint une file d'attente prioritaire, accélérant le crawl dans les heures suivantes.

- Notification de résultat : la console vous informe lorsque la page a été testée et indexée.

- Efficacité maximale : cette approche directe permet à un robot de crawler votre page corrigée.

Ne soumettez que les adresses réellement corrigées pour ne pas ralentir le traitement. Vérifiez toujours le bon fonctionnement de votre correctif via le test en direct avant validation.

Mettre à jour et soumettre le sitemap XML

Votre sitemap XML doit rester à jour pour que les moteurs découvrent rapidement vos pages. L'ajout de la balise lastmod aide à prioriser le passage des robots sur vos contenus récents. Maintenez une structure claire dans ce fichier, sans liens obsolètes ou dupliqués.

Rendez-vous ensuite dans la section index de la console pour y soumettre votre fichier principal. Le moteur repérera ainsi plus facilement toutes vos modifications récentes. Cette démarche globale accélère l'indexation sans exiger d'action manuelle répétitive.

- Balise lastmod : elle indique la date de modification pour mieux cibler le prochain passage des robots.

- Structure claire : proposez uniquement des adresses valides, sans doublons ou redirections inutiles.

- Soumission simplifiée : envoyer ce sitemap signale directement vos nouveautés pour une découverte plus réactive.

- API spécifique : pour les gros volumes, l'API dédiée autorise l'envoi de nombreuses requêtes quotidiennes.

Un sitemap XML bien entretenu est une excellente habitude. S'il demeure pertinent, l'indexation de vos pages importantes s'effectue rapidement.

Valider la correction et suivre la progression dans Search Console

Une fois le problème résolu, cliquez sur "Valider la correction" dans le rapport dédié. Une vérification officielle démarre, accompagnée de notifications sur la progression. Patientez quelques jours pour que les différentes pages affectées soient réévaluées. Lorsque tout est résolu, l'état indique une réussite, confirmant la bonne santé de votre site.

Prévenir les problèmes d'indexation sur votre site durablement

Corriger une erreur ponctuellement ne suffit généralement pas. Une approche proactive, fondée sur la qualité des contenus et une vigilance constante, permet de prévenir les problèmes d'indexation sur le long terme.

Qualité du contenu et architecture du site

Produire un contenu unique et bien structuré constitue votre meilleure garantie. Google privilégie la qualité et délaisse les textes pauvres ou dupliqués. Une architecture claire facilite l'exploration en évitant les pages orphelines.

- Contenu pertinent : chaque texte doit offrir une réelle valeur et répondre à une intention de recherche précise.

- Structure claire : utilisez les balises H1 à H3 pour guider l'indexation.

- Architecture plate : limitez la profondeur du site à trois clics maximum depuis la page d'accueil.

- Maillage interne solide : liez vos pages importantes avec des ancres contextuelles.

Bloquez l'accès aux pages sans valeur SEO pour préserver votre budget de crawl. Ainsi, chaque URL importante a bien plus de chances d’être indexée. Un site organisé performe toujours mieux qu’un espace désordonné.

Audit technique régulier pour anticiper les erreurs

Réaliser un audit technique SEO régulier permet de détecter les anomalies avant qu’elles n’affectent votre trafic. Vérifiez votre sitemap, les balises noindex et l’absence de pages 404. L’automatisation simplifie cette tâche.

- Vérification du robots.txt : assurez-vous de ne pas bloquer vos contenus essentiels.

- Analyse du noindex : recherchez les directives obsolètes après une refonte.

- Validation des balises canonical : confirmez qu’elles pointent vers la bonne URL.

Un outil automatisé remplace avantageusement les contrôles manuels, souvent longs. L’agent Nox surveille en continu votre site pour anticiper les failles techniques. Vous recevez une alerte avant qu’un véritable problème d'indexation n’apparaisse.

Surveillance continue pour réagir vite

Utiliser la Google Search Console permet de repérer rapidement une chute de visibilité. Une baisse du nombre de pages indexées signale souvent un problème récent. Intervenez sans tarder pour stabiliser votre trafic organique.

Cette veille permanente signale immédiatement les contenus bloqués ou exclus de l'index. Vous êtes notifié dès qu’une page quitte les résultats de recherche, pour un contrôle total de votre indexation.

L’écosystème Sedestral regroupe cinq agents spécialisés pour une gestion SEO complète. Nox automatise l'exploration de vos contenus sans intervention manuelle. Votre site reste ainsi performant et visible durablement.