Les grands modèles de langage (LLM) comme ChatGPT, Gemini, Perplexity ou Claude transforment radicalement l'accès à l'information en ligne. Contrairement aux moteurs de recherche classiques, ces solutions d'IA fournissent des réponses instantanées et synthétiques sans toujours diriger vers des sites externes.

👉 Comment obtenir des mentions de votre site dans ces réponses générées par l'IA ?

Ce guide détaille les meilleures approches en SEO et en GEO (Optimisation pour les Moteurs Génératifs), une nouvelle discipline du référencement spécialement adaptée aux intelligences artificielles génératives.

Pourquoi référencer son site sur ChatGPT et les LLM ?

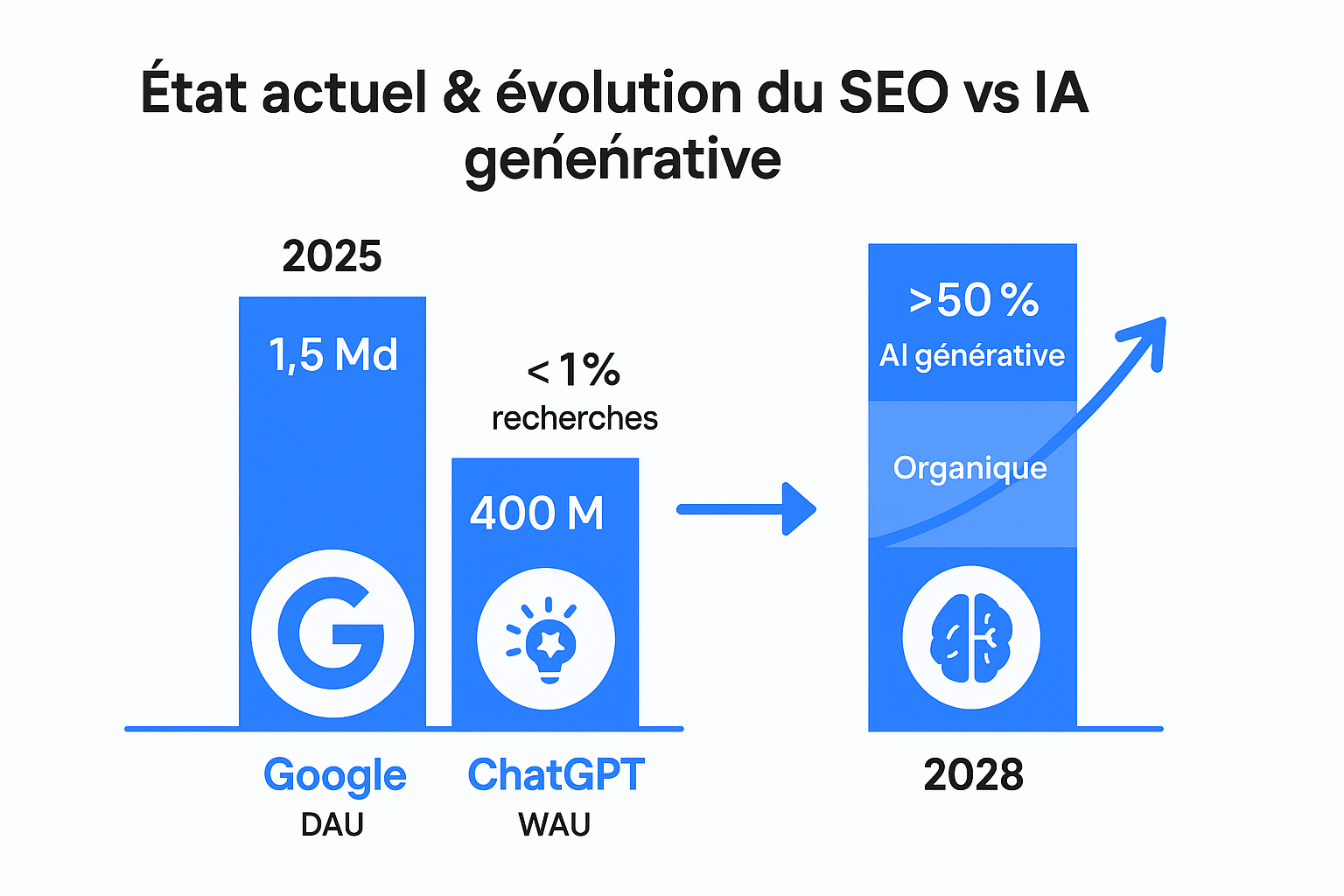

En 2026, malgré l'explosion des LLM comme ChatGPT : près de 400 millions d'utilisateurs hebdomadaires –, Google conserve sa domination avec environ 1,5 milliard d'utilisateurs quotidiens.

Bien qu'ultra-populaire, ChatGPT ne représente actuellement que moins de 1 % des recherches mondiales journalières.

👉 Le SEO traditionnel via Google et Bing reste donc absolument crucial aujourd'hui, et vos efforts en référencement demeurent essentiels.

Cependant, la situation évolue rapidement :

- L'adoption des IA génératives comme ChatGPT ou Gemini augmente mois après mois.

- Selon certaines projections, le trafic provenant des réponses IA pourrait même supplanter le trafic organique classique dès 2028.

Google ne va pas disparaître pour autant. Néanmoins, cela souligne l'importance de développer dès maintenant une stratégie de référencement adaptée aux LLM (GEO), en complément du SEO traditionnel.

À retenir : Optimiser pour Google reste indispensable, mais pour rester compétitif demain, il faut désormais adapter vos contenus aux IA. Leur influence ne fera que croître. Plus vous anticiperez cette transition stratégique en matière de référencement, d'engine optimization et de recherche, mieux vous vous positionnerez.

Comprendre le fonctionnement des LLM vs Google

Pour optimiser votre stratégie SEO face aux évolutions numériques, il faut d'abord bien comprendre les différences entre les moteurs de recherche traditionnels (comme Google) et les grands modèles de langage (LLM) tels que ChatGPT. Voici comment ces deux technologies fonctionnent concrètement :

Comment fonctionnent les moteurs de recherche comme Google ou Bing ?

Les moteurs de recherche comme Google utilisent des robots intelligents (crawlers) pour analyser en permanence le web. Lorsqu'un internaute effectue une recherche, le système :

- Consulte son index des pages web connues,

- Applique ses algorithmes de classement (basés sur la pertinence, la qualité du contenu, les backlinks, etc.),

- Affiche une liste de résultats avec des liens vers les sites les plus pertinents.

Ici, les pages web représentent la destination finale : l'utilisateur clique pour accéder au site concerné.

En savoir plus sur le fonctionnement de Google

Comment fonctionnent les LLM comme ChatGPT, GPT-4o, Perplexity, Claude ou Gemini ?

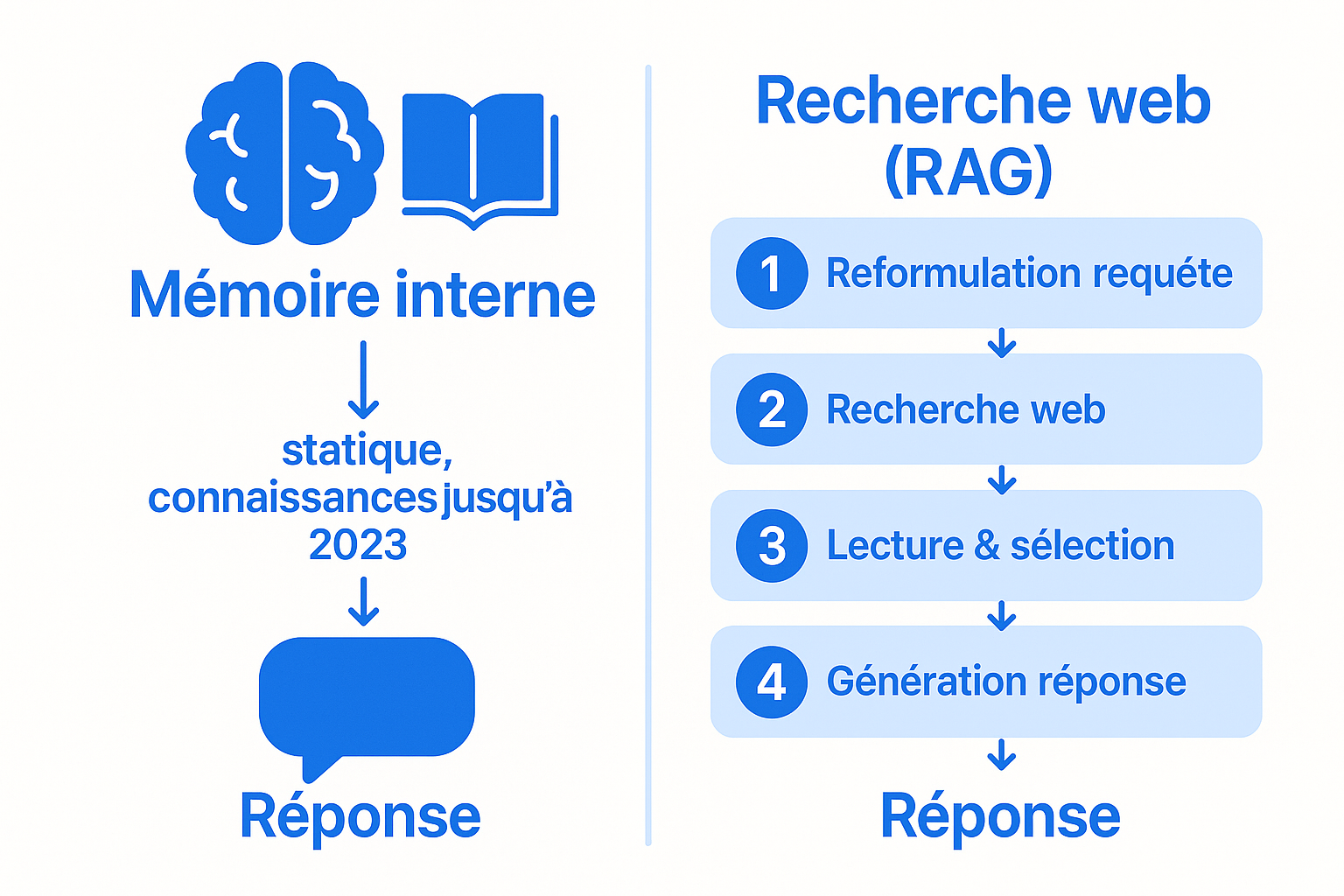

Les grands modèles de langage (LLM) utilisent deux méthodes principales pour répondre aux questions :

Leur mémoire interne (connaissances pré-entraînées)

Durant leur entraînement, les LLM analysent d'énormes quantités de données publiques :

Sites internet, encyclopédies, livres, forums, articles spécialisés, codes sources, etc.

Cela leur permet d'acquérir des connaissances générales, des compétences linguistiques et des capacités de raisonnement.

Toutefois, cette base de connaissances reste figée : elle ne s'actualise pas automatiquement (par exemple, GPT-4o s'arrête à fin 2023). Cela limite leur capacité à traiter des informations récentes ou très spécialisées.

L'accès direct au web via les moteurs de recherche

Pour compenser ces limites, certains modèles d'IA comme ChatGPT peuvent accéder en direct au web via des moteurs de recherche traditionnels. C'est le cas notamment de :

- GPT-4o (avec recherche via Bing),

- Perplexity.ai (qui croise plusieurs sources),

- Gemini (basé sur l'index Google),

- Copilot (connecté à Bing).

Ces systèmes utilisent une technologie appelée RAG (Retrieval-Augmented Generation), qui combine recherche d'information et génération de texte. Le processus se déroule en quatre étapes clés :

- Transformation de la requête : L'IA adapte la question de l'utilisateur en une ou plusieurs requêtes optimisées pour le web, qui correspondent généralement très bien aux intentions de recherche réelles.

- Interrogation du web : Ces requêtes sont ensuite envoyées en direct aux moteurs de recherche comme Google pour récupérer les informations les plus récentes (actualités, sites web, articles ou données déjà indexées).

- Lecture et sélection des sources : Le système analyse les premiers résultats (souvent le top 10 des pages), vérifie leur pertinence, en extrait les points clés et croise ces informations pour s'assurer de leur fiabilité.

- Génération de la réponse : Enfin, l'IA produit une réponse claire et bien structurée à partir des sources identifiées (parfois citées ou référencées), en visant la précision, l'exhaustivité et la facilité de vérification.

En résumé

| Source d'information | Contenu | Avantages | Limites |

| Mémoire interne (training) | Savoirs acquis pendant l'apprentissage du modèle de langage | Réponse rapide, vaste champ de connaissances | Manque d'actualités ou de données localisées |

| Recherche web intégrée | Résultats provenant de Bing, Google ou autres moteurs de recherche | Informations récentes, vérifiables et précises | Dépend de l'indexation et de la qualité des pages trouvées |

👉 Ces deux approches sont complémentaires.

Les LLM comme ChatGPT utilisent d'abord leur mémoire interne, puis, si besoin, consultent des sources externes pour enrichir ou actualiser leurs réponses.

La grande différence entre moteurs de recherche et LLM

La principale distinction entre un moteur de recherche traditionnel (comme Google) et un modèle de langage (tel que ChatGPT) réside dans leur façon de répondre :

- Les moteurs de recherche agissent comme des intermédiaires : ils proposent des liens vers différentes pages et laissent à l'utilisateur le soin de parcourir, évaluer et interpréter ces contenus pour trouver sa réponse.

- Les LLM, eux, jouent un rôle de synthétiseur : ils fournissent directement une réponse rédigée, basée soit sur leurs connaissances internes (issues de leur apprentissage), soit sur des données récupérées via une recherche web en temps réel.

👉 Google vous oriente vers la solution; ChatGPT vous la donne clé en main.

Cette différence modifie fondamentalement l'accès à l'information : l'un est un moteur de recherche conçu pour naviguer, l'autre un moteur génératif spécialisé dans la restitution synthétique.

Le SEO traditionnel : la clé pour exister dans l'univers des IA génératives

Il n'y a pas de raccourci : les intelligences artificielles, tout comme les internautes, utilisent Google et Bing pour leurs recherches.

Attention cependant : les IA ne se contentent pas d'effectuer une simple recherche sur Google comme un utilisateur lambda. Leur objectif est de reproduire le comportement humain... en l'améliorant, l'automatisant et l'accélérant.

Lorsqu'un internaute fait une requête, il scanne les titres, consulte quelques résultats, ouvre plusieurs liens, puis compare les informations avant de se faire une opinion. Ce processus est souvent guidé par l'intuition ou l'habitude.

Les intelligences artificielles, quant à elles, opèrent de manière bien plus rigoureuse et exigeante :

- Elles commencent par formuler des requêtes longues, complexes et ultra-précises, bien plus détaillées que celles des humains.

- Elles analysent les 3 à 10 premiers résultats - avec une nette préférence pour les premières positions - puis extraient et décortiquent méthodiquement leur contenu.

Elles évaluent chaque site avec une grande minutie :

- La qualité de la structure (titres hiérarchisés, paragraphes clairs, listes organisées)

- La clarté et la cohérence sémantique du contenu

- L'exactitude des informations fournies

- Et surtout, la pertinence exacte par rapport à la requête initiale

La différence cruciale : là où un internaute peut naviguer entre plusieurs pages ou tolérer des digressions, l'IA sélectionne et tranche sans état d'âme.

Elle choisit à la place de l'utilisateur ce qu'elle considère comme la réponse la plus appropriée.

Tout contenu jugé flou, mal structuré ou insuffisamment précis est immédiatement écarté. Il devient invisible aux yeux de l'intelligence artificielle.

⚠️ Conséquence majeure : vous ne ciblez plus uniquement des lecteurs humains, il faut désormais convaincre aussi les IA.

Un "bon contenu" ne suffit plus. Il faut un contenu :

- Parfaitement structuré

- Hyper-ciblé

- Facile à analyser

- Qui répond à tous les critères du référencement (SEO)

- Et qui incite l'IA à le reprendre dans ses réponses

🎯 En clair : le SEO ne se joue plus seulement devant vos visiteurs, mais aussi dans les algorithmes d'analyse des IA. Seuls les contenus extrêmement optimisés et pertinents ressortent gagnants.

Pourquoi c'est indispensable à l'ère de l'IA générative ?

Les modèles d'intelligence artificielle comme ChatGPT sont devenus des intermédiaires incontournables entre les internautes et l'information.

Pour fournir des réponses précises et actualisées, ils s'appuient massivement sur les moteurs de recherche traditionnels (Google, Bing). Mais contrairement aux requêtes sommaires des humains, les IA génèrent des questions :

- Longues et détaillées

- Richement contextualisées

- Reflétant une intention de recherche ultra-précise

Exemples concrets :

- Utilisateur humain : "meilleure montre homme"

- LLM : "quelle montre élégante pour homme à moins de 300 euros avec mécanisme automatique et bon rapport qualité/prix ?"

👉 Ce type de recherche exige une réponse parfaitement ciblée, sans la moindre ambiguïté. Elle doit être précise, bien organisée et immédiatement utile.

C'est ce nouveau paradigme qui révolutionne les règles du contenu web.

Comment les LLM utilisent les résultats de recherche ?

Lorsqu'elle reçoit une requête, l'IA accède à une page de résultats (SERP) - exactement comme un internaute.

Mais contrairement à un humain qui explore souvent plusieurs liens, l'IA suit une méthode de sélection rigoureuse :

- Elle examine les 3 à 10 premiers résultats, en privilégiant particulièrement le Top 3.

- Elle extrait automatiquement le contenu texte de ces pages.

- Elle évalue la qualité du contenu selon des critères stricts :

- Structure claire (titres, paragraphes, listes bien organisés)

- Facilité de lecture et cohérence

- Précision des réponses apportées

- Pertinence exacte par rapport à la recherche initiale

- Elle décide d'inclure - ou non - ce contenu dans sa réponse finale.

⚠️ Si votre page ne répond pas à ces critères - parce qu'elle est trop vague, mal rédigée ou mal ciblée - elle est systématiquement rejetée.

👉 Dans ce cas, l'IA ne perd pas de temps : elle passe simplement au résultat suivant.

Elle sélectionne alors le contenu d'un concurrent mieux optimisé, à la structure plus claire et plus pertinent.

🎯 Résultat : c'est votre concurrent qui bénéficiera de la visibilité dans les réponses de l'IA, et potentiellement des clics qui en découlent.

Vous avez fait l'effort... mais c'est un autre qui en tire profit.

Ce que cela implique pour votre stratégie SEO

Si vous voulez que votre contenu soit vu, retenu et utilisé par une IA - qu'il apparaisse dans ses réponses ou génère des clics - vous devez revoir votre approche :

Il ne suffit plus seulement de "séduire les visiteurs".

Désormais, il faut convaincre un lecteur invisible mais impitoyable : l'algorithme d'analyse des IA.

Pour y parvenir, certains principes deviennent absolument essentiels :

1. Être bien positionné dans les résultats de recherche

Sans visibilité, aucune analyse n'est possible.

Les IA se concentrent sur les 3 à 10 premières positions de Google, particulièrement sur le Top 3. Si votre page n'y figure pas, elle n'existe tout simplement pas pour leur processus de sélection.

Le travail SEO traditionnel (optimisation technique, richesse sémantique, backlinks) reste donc plus important que jamais.

2. Répondre à une intention de recherche précise

Les modèles de langage (LLM) recherchent avant tout des réponses précises, pas des généralités. Votre contenu doit répondre de manière concrète à une requête spécifique, comme proposer « des chaussures de randonnée légères adaptées aux terrains secs » plutôt qu'un « guide général sur les chaussures ».

Chaque page doit traiter un sujet unique, clairement défini pour être immédiatement identifiable par les systèmes d'IA.

3. Proposer un contenu parfaitement structuré

Les intelligences artificielles analysent votre contenu pour y extraire les informations pertinentes.

Plus votre texte est bien organisé, hiérarchisé et aéré, plus il devient facile à comprendre et à réutiliser.

Pour y parvenir, utilisez systématiquement :

- Une structure de titres logique (H1, H2, H3…)

- Des paragraphes courts et faciles à lire

- Des listes à puces ou numérotées

- Des tableaux, définitions et encadrés

- Des données fiables et facilement exploitables (chiffres, dates, sources claires)

4. Supprimer tout le superflu

Les IA ne tolèrent pas la complaisance. Elles n'ont ni le temps ni la patience pour extraire l'information utile d'un texte mal construit ou trop long.

Bannissez les phrases inutiles, les digressions et le jargon inutile.

Votre contenu doit être direct et efficace, sans détour inutile.

En résumé

Le référencement (SEO) de votre site ne concerne plus seulement vos visiteurs humains.

Il s'étend désormais à son interprétation par les intelligences artificielles.

Les modèles comme ChatGPT, Gemini ou Perplexity ne lisent pas chaque mot. Ils sélectionnent, analysent et décident de ce qui compte vraiment.

Ce sont eux qui déterminent quel contenu mérite d'être vu, compris et partagé - avant même que l'utilisateur final ne le découvre.

Et ce qu'ils choisissent, ce n'est pas du texte brouillon, mal organisé ou trop vague.

Ce qu'ils recherchent activement, ce sont des réponses claires, précises, bien structurées et parfaitement alignées avec l'intention de recherche spécifique de l'utilisateur.

👉 Avoir un bon classement seul ne suffit plus.

👉 Avoir un style élégant ne suffit plus.

👉 Fournir des informations génériques ne suffit plus.

La clé aujourd'hui réside dans votre capacité à créer du contenu utile pour l'utilisateur... et immédiatement exploitable par l'IA.

Un contenu qui maîtrise à la fois les aspects techniques (SEO, structure, balisage), éditoriaux (clarté, concision, pertinence) et stratégiques (réponse directe à une requête précise).

Imaginez chaque page comme une réponse idéale à une question posée à une IA.

Car si vous ne le faites pas, vos concurrents, eux, s'en chargeront.

Et c'est leur contenu - pas le vôtre - qui sera sélectionné, cité, résumé et affiché.

Ce sont eux qui gagneront en visibilité, en autorité... et donc en trafic qualifié.

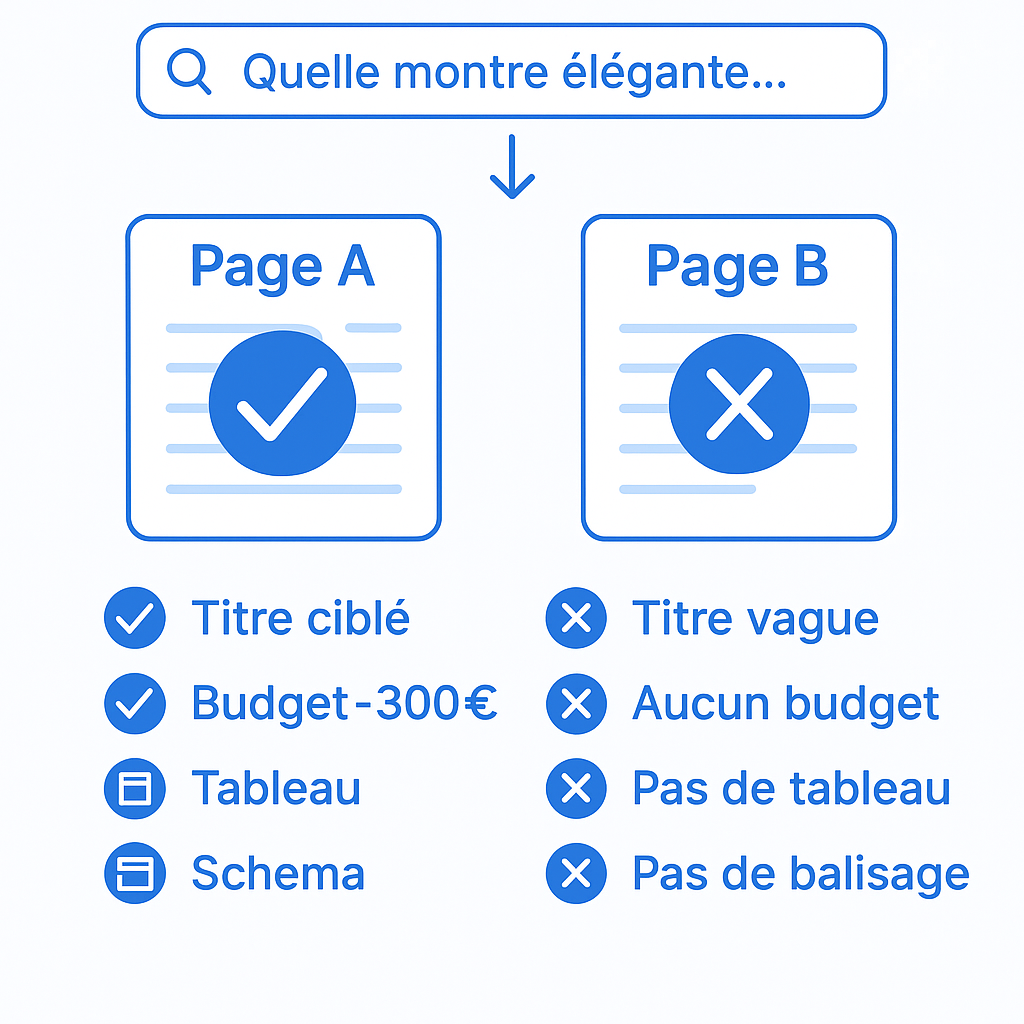

Cas pratique : Deux pages web face à une requête IA : laquelle gagne ?

Imaginez une requête typique qu'un internaute pourrait soumettre à une intelligence artificielle comme ChatGPT ou Perplexity :

« Quelle montre élégante pour homme à moins de 300 euros avec mécanisme automatique et bon rapport qualité/prix ? »

L'IA parcourt alors les résultats de recherche sur Google pour trouver les pages les plus pertinentes. Elle identifie deux contenus très différents : la page A et la page B.

✅ Page A (retenue par l'IA)

Titre principal :

« Comparatif : Top 7 montres automatiques élégantes pour homme à moins de 300 € ( 2026 ) »

Points forts du contenu :

- Un titre clair qui correspond exactement à la requête

- Un focus exclusif sur les montres automatiques

- Un budget précis mentionné dès le départ

- Des critères de comparaison bien définis (design, fiabilité, mécanisme, prix, rapport qualité/prix)

- Une structure impeccable avec des titres H1, H2 et H3 bien utilisés

- Un tableau comparatif organisé avec modèles, prix, caractéristiques

- Des descriptions courtes, précises et centrées sur les bénéfices client

- L'utilisation de données structurées (

schema.org) pour faciliter le traitement par l'IA

❌ Page B (ignorée par l'IA)

Titre principal :

« Comment bien choisir une montre pour homme ? »

Problèmes majeurs :

- Un titre trop vague qui ne correspond pas à la recherche

- Tous types de montres mélangés sans distinction

- Aucune indication claire sur les prix

- Des critères de choix flous et mal organisés

- Une mauvaise structure avec peu de sous-titres et des paragraphes trop longs

- Pas de comparatif pratique entre les produits

- Du contenu verbeux parfois hors sujet

- Aucun balisage structuré, ce qui rend l'analyse difficile pour les systèmes automatisés

Tableau comparatif : Page A vs Page B

| Critère | ✅ Page A (retenue) | ❌ Page B (ignorée) |

| Titre | Clair et ciblé (montres automatiques élégantes, < 300 €) | Flou et généraliste |

| Type de montres | Uniquement des modèles automatiques | Mélange tous les types sans aucune hiérarchie |

| Budget ciblé | Budget explicite (moins de 300 €) | Budget non précisé |

| Critères précis | Définis dès l'introduction (style, prix, mécanisme) | Flous, dispersés et non structurés |

| Structure claire (Hn) | Oui : titres hiérarchisés H1, H2, H3 | Non, structure faible |

| Tableau comparatif | Présent : modèles, prix, mécanisme, matériaux | Absent |

| Descriptions produits | Courtes, précises et immédiatement exploitables | Longues, marketing et peu utilisables |

| Balisage structuré SEO | Oui : schema.org et données structurées | Non |

Pourquoi l'IA retient-elle uniquement la Page A ?

L'analyse automatisée ne sélectionne pas les pages par hasard. Elle privilégie systématiquement celles qui :

- Répondent précisément à la requête initiale.

- Présentent une structure claire et une lecture fluide.

- Facilitent le travail d'analyse grâce à une organisation rigoureuse.

- Permettent une extraction aisée des données grâce à des balisages appropriés (schema.org).

À l'inverse, un contenu vague ou mal organisé comme la Page B sera systématiquement écarté, même s'il apparaît pour des requêtes génériques.

Optimiser votre site pour les algorithmes d'IA nécessite aujourd'hui une approche extrêmement ciblée :

- Création de pages ultra-spécifiques

- Structure logique avec une architecture bien pensée

- Alignement parfait avec les intentions de recherche précises

Négliger ces aspects revient à laisser le champ libre à vos concurrents mieux préparés.

Structurer votre contenu pour les LLM : les règles d'or

Pour que votre contenu soit bien compris et exploité par les modèles d'IA comme les LLM, une structure claire et une bonne optimisation SEO sont essentielles. Voici les bonnes pratiques à suivre pour maximiser votre visibilité et trafic.

Commencez par un TL;DR synthétique

Placez dès le début de votre page un résumé bref et percutant (1 à 3 phrases maximum). Ce preview doit donner l'essentiel de l'information pour être repris tel quel par ChatGPT ou d'autres outils d'IA.

Exemple : « Optimisez vos contenus structurés pour les LLM avec des titres clairs (H1-H3), des listes et des données structurées. Un texte court et bien organisé améliore vos chances d'être référencé. »

Organisez en Question/Réponse et listes exploitables

Privilégiez les questions-réponses courtes (1-2 phrases), complétées si besoin par quelques paragraphes explicatifs. Les listes à puces et tableaux sont idéaux pour que les LLM analysent facilement l'information.

Terminez toujours par une FAQ concise avec des réponses clés, directement exploitables.

Utilisez une hiérarchie logique des titres (H1 > H2 > H3)

Chaque titre doit être court, précis et riche en mots-clés. Pensez aussi à ajouter des ancres HTML comme #optimisation-seo ou #donnees-structurees pour faciliter la navigation et l'indexation.

Multipliez les exemples chiffrés et check-lists

Pour capter l'attention des LLM, incluez dans vos contenus structurés :

- Des résultats chiffrés (ex. : « Augmentation de 150 % du trafic organique »)

- Des listes d'actions claires (étapes, points-clés)

- Des cas pratiques avec méthode et résultats sourcés

Prévoyez un bloc "Comment citer cette page"

Facilitez la réutilisation de votre contenu en proposant plusieurs formats de citation (APA, Chicago...). Cela encourage les LLM à vous citer correctement.

Implémenter le balisage et les données structurées pour une visibilité optimale

Pour maximiser votre visibilité et augmenter vos chances d'être référencé par les LLM, l'utilisation d'un balisage structuré est essentielle.

Ce type de balisage permet aux systèmes d'IA de comprendre, extraire et réutiliser efficacement vos contenus.

Déployez les balises JSON-LD essentielles

Intégrez les schémas appropriés de schema.org en fonction de vos différents types de pages :

- Article : pour vos contenus éditoriaux (blogs, guides, tutoriels)

- FAQPage et QAPage : parfait pour vos sections questions/réponses

- HowTo : idéal pour les tutoriels détaillés

- Dataset : adapté à vos études et données structurées

- Person/Organization : renforce votre crédibilité et l'E-E-A-T

- Product/Review : essentiel pour vos fiches produits et avis

- Breadcrumb : améliore la navigation et le contexte

Encapsulez FAQ, TL;DR et datasets dans un balisage dédié

Tous vos éléments clés (résumés, questions-réponses, tableaux) doivent être clairement identifiables par les robots et systèmes RAG grâce à un balisage approprié.

Cette bonne pratique augmente significativement vos chances d'apparaître dans les réponses générées par les LLM.

Exposez des endpoints machine-readable

Si possible, proposez des API publiques (ex: /api/knowledge, /api/summary) renvoyant les métadonnées essentielles (titres, résumés, dates de modification).

Ces données structurées facilitent l'intégration automatique par les agents IA ou partenaires tiers.

Optimisez les méta OpenGraph et Twitter Card

Maîtrisez l'apparence de vos extraits lors du partage ou de la citation par les assistants.

Rédigez une description concise (120-150 caractères) incluant votre résumé principal, en veillant à son exactitude.

Garantissez la présence du contenu structuré dans le HTML initial

Tous vos contenus stratégiques (texte, FAQ, tableaux, JSON-LD) doivent être disponibles dès le chargement (SSR/SSG), sans dépendre du JavaScript côté client.

Assurez-vous que les robots et LLM puissent accéder immédiatement à vos données structurées sans délai.

Renforcer l'E-E-A-T pour gagner la confiance des LLM

Pour que les grands modèles de langage considèrent votre contenu comme crédible, il est essentiel de travailler votre E-E-A-T (Expérience, Expertise, Autorité et Confiance). Voici comment y parvenir :

Affichez clairement l'auteur et ses qualifications

Chaque article doit être clairement attribué à son auteur. Assurez-vous d'inclure :

- Une biographie détaillée mettant en avant les compétences,

- Une photo professionnelle pour humaniser le contenu,

- Les titres et certifications pertinents,

- Des liens vers profils publics (LinkedIn, site perso, etc.),

- Un balisage sémantique JSON-LD pour faciliter la lecture par les IA.

Citez systématiquement vos sources externes

Toute affirmation doit pouvoir être vérifiée. Pour cela :

- Mentionnez les sources originales (études, rapports),

- Indiquez les dates des données,

- Ajoutez des documents techniques en annexe si besoin,

- Créez une section "Références" en fin d'article.

Cette traçabilité renforce considérablement votre crédibilité aux yeux des LLM qui analysent vos pages.

Soyez transparent sur l'usage de l'IA

Si vous utilisez des outils d'IA pour la rédaction :

- Affichez clairement une mention comme "Rédigé avec assistance IA - Validé par nos experts",

- Décrivez votre processus éditorial avec relecture humaine.

Cette honnêteté évite la désinformation et améliore la confiance dans votre site.

Fournissez des preuves d'expérience pratique

Illustrez votre expertise par :

- Des études de cas concrets (problème, solution, résultats),

- Des protocoles de tests reproductibles,

- Des chiffres précis ("Augmentation de 287% du trafic").

Ces éléments prouvent votre expérience et différencient votre contenu des pages génériques.

Obtenez et affichez des backlinks de qualité

Les backlinks provenant de sites d'autorité (médias spécialisés, institutions) constituent de puissants signaux de confiance pour les LLM qui analysent votre profil de liens.

Notre guide complet détaille une méthodologie efficace pour optimiser votre contenu SEO en 2026 : analyse SERP, construction de cocons sémantiques, balisage structuré, optimisation technique et suivi des indicateurs. Nous mettons l'accent sur :

- L'approche E-E-A-T

- L'usage responsable des grands modèles de langage (outils d'aide, validation humaine)

- La gestion du cycle de vie du contenu (mises à jour régulières)

Une stratégie indispensable pour générer un trafic durable et réussir son référencement à l'ère des LLM.

Découvrir le guide complet pour réussir le référencement LLM

Stratégies backlinks et signaux d'autorité adaptés aux LLM

Les modèles de langage (LLM) accordent une grande importance à la qualité des sources qui citent votre contenu. Une bonne stratégie de netlinking bien ciblée augmente significativement vos chances d'être référencé et mentionné.

Priorisez quelques backlinks hautement qualitatifs

Privilégiez la qualité à la quantité. Quelques liens provenant de sites d'autorité dans votre niche (comme LeMonde.fr ou des blogs experts en SEO) valent mieux qu'une multitude de liens peu pertinents.

Points clés à vérifier :

- Pertinence thématique : le site source doit traiter du même sujet que le vôtre

- Autorité du domaine : analyser le Trust Flow, Domain Rating et trafic organique

- Position du lien : intégré naturellement dans le contenu (pas en footer ou sidebar)

- Texte d'ancre : naturel, varié et sans optimisation excessive

Appliquez la règle 80/20 sur les ancres

Pour un profil de liens naturel :

- 80% d'ancres brutes (nom de marque, URL, "cliquez ici")

- 20% d'ancres optimisées (ex: "référencement pour ChatGPT ")

Cette approche renforce votre crédibilité auprès des moteurs de recherche et des systèmes d'IA comme Google.

Développez des "aimants à liens"

Créez des contenus qui suscitent naturellement des liens :

- Études originales avec des données uniques

- Infographies facilement partageables

- Outils gratuits utiles à votre audience

- Jeux de données réutilisables

Ces ressources augmentent vos chances d'être référencé par des sites spécialisés ou des médias.

Traquez et convertissez les mentions non liées

Utilisez Google Alerts ou des outils comme Ahrefs pour identifier les mentions sans lien vers votre site. Contactez ensuite les auteurs pour transformer ces mentions en backlinks.

Contrôlez manuellement la qualité des plateformes d'acquisition

Vérifiez systématiquement :

- La thématique réelle du site (évitez les fermes de liens)

- Le Trust Flow et Domain Rating

- Le trafic organique récent

Privilégiez 2 à 5 backlinks pertinents chaque mois et suivez-les via Ahrefs ou Google Search Console.

Ce guide complet détaille une méthode efficace pour obtenir des backlinks durables : audit concurrentiel, identification d'opportunités (guest blogging, liens brisés), sélection rigoureuse des sites cibles et suivi des résultats. Ces bonnes pratiques améliorent l'autorité et la visibilité de votre site, tout en renforçant ses signaux de référencement pour les LLM et moteurs comme Google.

Consulter le guide complet du netlinking pour améliorer votre référencement

Accessibilité technique, crawlabilité et fraîcheur du contenu

Pour qu'un LLM puisse correctement analyser et utiliser votre contenu, votre site doit être techniquement impeccable. Voici les points clés à surveiller en permanence :

Assurez un rendu server-side ou pré-rendu

Le contenu principal, y compris les FAQ et résumés, doit être généré côté serveur (SSR) ou pré-compilé (SSG). Évitez les contenus qui s'affichent uniquement via JavaScript côté client, car ils risquent de passer inaperçus pour les robots et les LLM.

Publiez un sitemap.xml et un flux RSS/Atom à jour

Maintenez un sitemap.xml bien organisé et à jour, listant toutes vos pages importantes. Un flux RSS ou Atom permet aux outils d'IA de détecter rapidement vos nouveaux contenus et mises à jour.

Mettez à jour les balises datePublished et dateModified

À chaque modification importante d'un contenu existant, pensez à actualiser la balise dateModified dans votre balisage JSON-LD. Cela montre aux LLM que votre information est récente, augmentant ainsi vos chances d'être référencé.

Utilisez des URL stables et des balises canoniques

Évitez de modifier vos URL. Si c'est nécessaire, implémentez des redirections 301 et utilisez des balises canoniques pour consolider l'autorité sur une version unique de chaque contenu. Proposez également des versions imprimables ou PDF pour faciliter le partage.

Incluez les balises OpenGraph et Twitter pour garantir des extraits cohérents

Contrôlez les extraits partagés sur les réseaux sociaux et les assistants vocaux en optimisant vos balises OpenGraph (title/description) et Twitter Card pour qu'elles reflètent précisément votre contenu.

Contrôlez robots.txt et surveillez l'indexation

Vérifiez que votre fichier robots.txt ne bloque pas accidentellement l'accès à vos contenus stratégiques avec des directives Disallow ou noindex.

Surveillez l'indexation via Google Search Console et soumettez manuellement vos nouvelles pages ou mises à jour importantes pour accélérer leur prise en compte par les moteurs de recherche comme Google.

Mesure, KPIs et monitoring de la présence dans les LLM

Pour optimiser efficacement votre visibilité dans les LLM, il est crucial de mettre en place un suivi rigoureux de vos performances. Voici les principaux indicateurs à analyser et les actions concrètes à mener pour améliorer votre présence :

Suivez les citations dans les assistants conversationnels

Testez régulièrement des requêtes spécifiques sur ChatGPT et autres plateformes comme Perplexity ou Gemini pour vérifier si votre site apparaît dans les réponses. Analysez ensuite la façon dont vos contenus sont cités.

Parallèlement, surveillez le trafic provenant des interfaces IA via Google Analytics (en identifiant les sources referral, direct ou les user-agents spécifiques lorsque possible).

Indicateurs clés à suivre

- Fréquence des mentions : combien de fois vos contenus sont cités dans les réponses IA;

- Backlinks organiques : nouveaux liens générés naturellement suite à une citation;

- Comportement des visiteurs IA : taux de rebond, durée de session et conversions;

- Extraits mis en avant : passages de vos pages apparaissant en position 0 ou intégrés aux réponses.

Outils essentiels

- Analyse sémantique : évaluez la pertinence de votre vocabulaire et son ajustement aux requêtes;

- Outils de crawl SEO : comme Screaming Frog pour auditer la structure de votre site;

- Validation des schémas : utilisez schema.org Validator pour vos balises JSON-LD;

- Tests automatisés : mettez en place des scripts pour suivre l'évolution de vos résultats dans les LLM.

Roadmap opérationnelle

- Identifier les questions utilisateurs : recueillez les vraies interrogations de votre audience;

- Créer du contenu ciblé : développez des pages dédiées répondant précisément à ces questions;

- Baliser avec schema.org : implémentez systématiquement les formats FAQ et HowTo;

- Piloter et ajuster : suivez les performances et adaptez vos contenus en fonction;

- Optimiser en continu : affinez titres et structure en vous basant sur les retours des LLM.

Agissez tôt pour bénéficier du first-mover advantage

Les secteurs comme l'e-commerce, la finance ou la santé verront rapidement l'impact des LLM sur leur trafic. En anticipant ces changements et en optimisant vos contenus dès maintenant, vous prenez une avance décisive en matière de SEO et positionnez votre site comme référence.

Contrôle d'accès, sécurité et politique vis-à-vis des bots IA

L'évolution rapide des LLM soulève des enjeux cruciaux de sécurité, de contrôle et de gestion de vos contenus. Voici nos conseils pour réguler l'accès des systèmes d'IA à vos données :

Maîtrisez robots.txt et headers HTTP

Les fichiers robots.txt et les en-têtes HTTP (comme X-Robots-Tag) permettent de limiter l'accès des crawlers. Attention cependant : certains bots IA ne respectent pas systématiquement ces directives.

Pensez également à utiliser les nouveaux standards comme llms.txt pour préciser vos règles d'accès spécifiques aux modèles de langage.

Mettez en place un monitoring des user-agents IA

Surveillez dans vos logs serveur les user-agents des bots IA (comme GPTBot, ClaudeBot ou googleOther). Configurez ensuite des mécanismes de rate-limiting ou de blocage ciblé si leur trafic devient trop intensif.

Protégez le contenu sensible

Pour vos contenus à haute valeur, plusieurs solutions :

- Balises noindex : empêchez l'indexation de certaines pages,

- Paywall ou authentification : réservez l'accès complet à vos abonnés,

- Extraits publics + accès payant : proposez un résumé gratuit puis le contenu intégral après paiement,

- API sécurisée : diffusez vos données via une API contrôlée.

Transparence et responsabilité

Soyez explicite sur :

- Vos sources : études, experts, données utilisées,

- Les limites de vos affirmations : contexte, portée, actualité,

- Votre processus éditorial : utilisation d'IA, relecture humaine.

Cette transparence réduit les risques de désinformation et renforce la crédibilité auprès des LLM comme des utilisateurs.

Offrez des alternatives machine-readable sécurisées

Quand c'est pertinent, proposez des API publiques, des jeux de données ouverts (CSV, JSON) ou des PDF protégés pour faciliter la réutilisation tout en gardant le contrôle de vos contenus.

Organisation interne, audit continu et collaboration des équipes

Pour maintenir durablement votre visibilité dans les LLM, il est essentiel de structurer vos processus et d'harmoniser le travail entre vos équipes.

Voici les meilleures pratiques à adopter :

Processus mensuel d'audit et d'optimisation

Implémentez un cycle d'audit mensuel complet comprenant :

- Analyse du contenu : identifier les pages obsolètes, peu performantes ou dupliquées

- Regroupement des contenus similaires : fusionner les articles redondants pour éviter les problèmes de SEO

- Actualisation des métadonnées : vérifier et mettre à jour les titres, descriptions et balises schema.org

- Contrôle qualité : relecture approfondie, validation des sources et homogénéité du ton

Coordination des équipes éditoriale et technique

Assurez une synergie permanente entre rédacteurs, spécialistes SEO et développeurs pour :

- Maintenir une structure claire (titres Hn, listes, tableaux)

- Optimiser les performances techniques (affichage SSR, vitesse de chargement, Core Web Vitals)

- Respecter les normes de balisage (schema.org, OpenGraph)

Utilisez des checklists pré-publication

Avant publication, vérifiez scrupuleusement :

- La hiérarchie des titres (H1 unique, H2/H3 logiques)

- Les métadonnées (title, description, cartes sociales)

- La structure des URLs (court, clair, stable)

- Les données structurées (JSON-LD Article, FAQ, HowTo)

- Les dates de publication (datePublished, dateModified bien renseignées)

- Les références citées (liens externes, sources académiques)

Renforcez la biographie des auteurs

Enrichissez constamment les profils auteurs avec :

- Une présentation professionnelle détaillée

- Les diplômes et certifications pertinents

- Des liens vers leurs réseaux professionnels

- Un balisage JSON-LD Person pour une bonne interprétation par les IA

Veille IA et tests périodiques

Mettez en place un dispositif de veille sur l'évolution des LLM (nouveautés, changements algorithmiques). Testez régulièrement vos contenus clés dans ChatGPT et autres assistants, puis affinez votre stratégie éditoriale en fonction des résultats.

Formats performants et diffusion multicanale

Les LLM (modèles de langage avancés) comprennent et traitent plus efficacement certains types de contenu. Découvrez les formats les plus adaptés ainsi que les meilleures méthodes pour les diffuser et maximiser votre visibilité :

Formats à privilégier

- FAQ : un format idéal avec des questions claires et des réponses concises,

- Guides pas-à-pas : des tutoriels bien organisés en étapes numérotées pour une meilleure compréhension,

- Comparatifs « Top N » : des tableaux synthétiques qui facilitent la comparaison entre différents produits ou solutions,

- Études chiffrées : des données exclusives, benchmarks et résultats de tests pour appuyer vos arguments.

Ces formats aident à une meilleure extraction automatique des données par les algorithmes d'IA et augmentent vos chances d'être référencé.

Diffusez sur réseaux sociaux et plateformes tierces

Pour créer un impact maximal et améliorer votre référencement (SEO), publiez vos contenus structurés sur :

- Réseaux sociaux : LinkedIn, Twitter/X, et Facebook pour une large diffusion,

- Newsletters : via des plateformes comme Substack, Beehiiv ou Mailchimp pour atteindre un public ciblé,

- Plateformes éditoriales : Medium, Quora, Reddit ou des forums spécialisés pour toucher une audience engagée.

Chaque partage et mention renforce votre présence en ligne et augmente les chances que les LLM comme ChatGPT vous identifient comme une source fiable.

Choisissez un CMS SEO-friendly

Pour une optimisation efficace, privilégiez les CMS qui prennent en charge le balisage et les données structurées :

- WordPress (avec des extensions comme Yoast SEO ou Rank Math pour un meilleur référencement),

- Webflow (offre une bonne flexibilité en design tout en intégrant des outils SEO avancés),

- Shopify (idéal pour les sites e-commerce avec des applications dédiées au SEO),

- Gatsby et Next.js (parfaits pour les sites modernes avec rendu côté serveur ou génération statique).

Adaptez l'optimisation selon l'écosystème

- Bing pour ChatGPT : assurez-vous que votre site est bien indexé dans Bing Webmaster Tools,

- Google pour Gemini/Copilot : commencez par optimiser votre référencement via Google Search Console,

- Perplexity : misez sur des contenus bien organisés, des FAQ et des sources citées.

Contrôlez la visibilité : possibilité de désindexation partielle

Si nécessaire, utilisez les balises noindex, configurez le fichier robots.txt ou ajoutez une authentification pour limiter l'accès des robots d'indexation. Cependant, ces méthodes ne sont pas infaillibles et évoluent constamment. Surveillez régulièrement les changements dans le comportement des LLM et ajustez votre stratégie en conséquence pour maintenir une visibilité optimale sur votre site.